Нечеткая логика и нейросети

Содержание:

Введение

1. История развития нейронных сетей

Начало развития электронно-вычислительной техники пришлось на середину XX века.

Ученые еще не пришли к единому мнению он том, по какому принципу должна работать типовая электронно-вычислительная машина.

Джон фон Нейман предложил имитацию простых функций нейронов с использованием вакуумных трубок и по архитектуре машины созданной фон Неманом построены почти все современные компьютеры.

В те же годы были предложены принципиально иные архитектуры и принципы действия компьютеров. Одна из таких схем получила название нейросетевого компьютера, или просто нейросети.

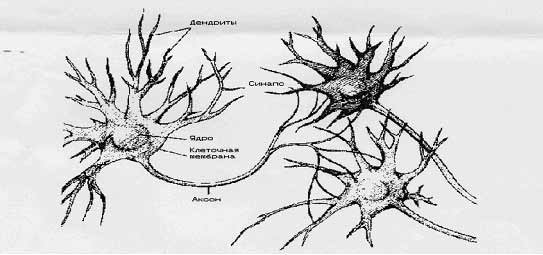

Главные части нервной клетки - это ее тело, содержащее ядро и другие органеллы, единственный аксон, передающий импульсы от клетки, и дендриты, к которым приходят импульсы от других клеток. Первый интерес к нейросетям был обусловлен пионерской работой МакКаллока и Питса, изданной в 1943 году, где предлагалась схема компьютера, основанного на аналогии с работой человеческого мозга. Они создали упрощенную модель нервной клетки - нейрон.

2. Аналогия нейронных сетей с мозгом и биологическим нейроном

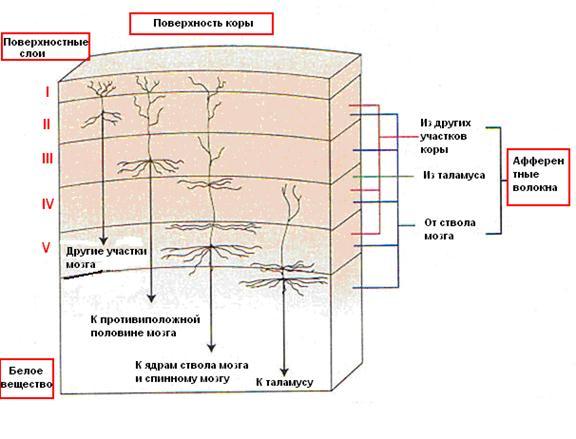

Мозг человека состоит из белого и серого веществ: белое - это тела нейронов, а серое - это соединительная ткань между нейронами, или аксоны и дендриты. Мозг состоит примерно из 10^11 нейронов. Главные части нервной клетки - это ее тело, содержащее ядро и другие органеллы, единственный аксон, передающий импульсы от клетки, и дендриты, к которым приходят импульсы от других клеток связанных между собой. Каждый нейрон получает информацию через свои дендриты, а передает ее дальше только через единственный аксон, разветвляющийся на конце на тысячи синапсов (см. рис. 1).

Главные части нервной клетки - это ее тело, содержащее ядро и другие органеллы, единственный аксон, передающий импульсы от клетки, и дендриты, к которым приходят импульсы от других клеток связанных между собой. Каждый нейрон получает информацию через свои дендриты, а передает ее дальше только через единственный аксон, разветвляющийся на конце на тысячи синапсов (см. рис. 1).

Рис 1.

Итак, в мозгу содержится около 10^15 взаимосвязей. Нейроны взаимодействуют посредством серий импульсов, длящихся несколько миллисекунд, каждый импульс представляет собой частотный сигнал с частотой от нескольких единиц до сотен герц. Это невообразимо медленно по сравнению с современными компьютерами, но в тоже время человеческий мозг гораздо быстрее машины может обрабатывать аналоговую информацию, например : узнавать изображения, чувствовать вкус, узнавать звуки, читать чужой почерк, оперировать качественными параметрами. Все это реализуется посредством сети нейронов, соединенных между собой синапсами. Таким образом, мозг — это система из параллельных процессоров, которые намного эффективнее, чем последовательные вычисления.

В настоящее время стоит проблема развития методов параллельного программирования и создания параллельных компьютеров. Очередной шаг в этом направлении - нейросети .

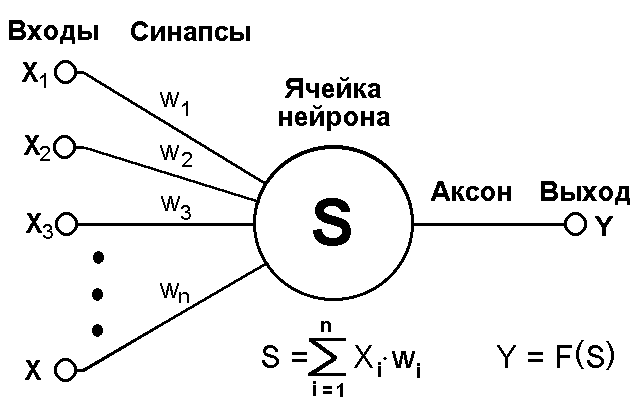

3. Искусственный нейрон

Искусственный нейрон имитирует в первом приближении свойства биологического нейрона. На вход искусственного нейрона поступает некоторое множество сигналов, каждый из которых является выходом другого нейрона. Каждый вход умножается на соответствующий вес, аналогичный синаптической силе, и все произведения суммируются, определяя уровень активации нейрона. На рис. 2 представлена модель, реализующая эту идею. Множество входных сигналов, x1, x2,…, xn, поступает на искусственный нейрон. Эти входные сигналы, в совокупности обозначаемые вектором X, соответствуют сигналам, приходящим в синапсы биологического нейрона. Каждый сигнал умножается на соответствующий вес w1, w2,…, wn, и поступает на суммирующий блок. Каждый вес соответствует «силе» одной биологической синаптической связи.

Рис.2 Искусственный нейрон

Текущее состояние нейрона определяется, как взвешенная сумма его входов:

Выход нейрона есть функция его состояния: y = f(s)

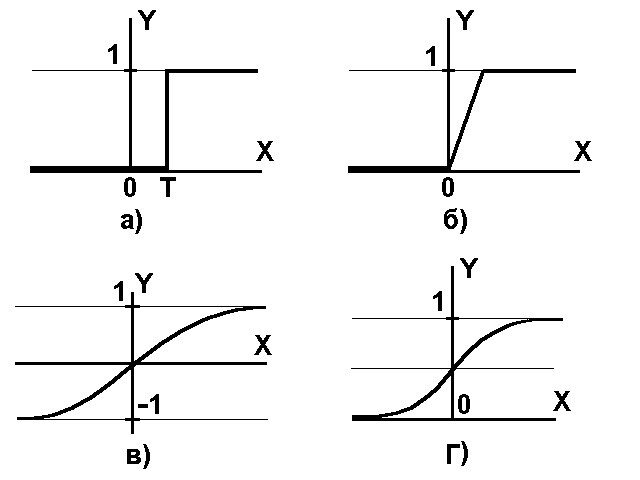

Нелинейная функция f называется активационной и может иметь различный вид, как показано на рисунке 3.

Рис.3 а)функция единичного скачка; б) линейный порог (гистерезис); в)гиперболический тангенс; г)сигмоид.

Одной из наиболее распространенных является нелинейная функция с насыщением, так называемая логистическая функция или сигмоид (т.е. функция S-образного вида):

Как можно составлять из отдельных нейронов сети? Используют несколько стандартных архитектур, из которых путем вырезания лишнего либо добавления строят большинство используемых сетей.

4.Виды искусственных нейронных сетей

Искусственные нейронные сети состоят из совокупности искусственных нейронов. Стоит вопрос: как соединять друг с другом искусственные нейроны?

В большинстве нейронных сетей есть входной слой, который выполняет задачу – распределение входных сигналов остальным нейронам. Нейроны этого слоя не производят никаких вычислений.

Дальше происходит разделение:

Однослойные нейронные сети

В однослойных нейронных сетях сигналы с входного слоя сразу подаются на выходной слой. Он производит необходимые вычисления, результаты которых сразу подаются на выходы.

Выглядит однослойная нейронная так:

Здесь входной слой обозначен кружками , а справа нахоится слой обычных нейронов.

Нейроны соединены друг с другом стрелками. Над стрелками расположены весовые коэффициенты.

Однослойная нейронная сеть (Single-layer neural network) – сеть, в которой сигналы от входного слоя сразу подаются на выходной слой, который и преобразует сигнал и сразу же выдает ответ.

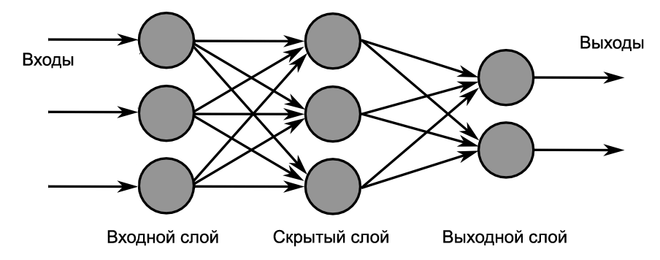

Многослойные нейронные сети

Эти сети, характеризуются еще и скрытым слоем, которые находятся между входным и выходным слоями.

Такая структура нейронных сетей копирует многослойную структуру определенных отделов мозга.

Многослойные нейронные сети обладают гораздо большими возможностями, чем однослойные.

Многослойная нейронная сеть (Multilayer neural network) – нейронная сеть, состоящая из входного, выходного и расположенного(ых) между ними одного (нескольких) скрытых слоев нейронов.

Сети прямого распространения

(Feedforward neural network) (feedforward сети) – искусственные нейронные сети, в которых сигнал распространяется строго от входного слоя к выходному. В обратном направлении сигнал не распространяется.

Такие сети широко используются и вполне успешно решают определенный класс задач: прогнозирование, кластеризация и распознавание.

Однако никто не запрещает сигналу идти и в обратную сторону.

Сети с обратными связями

(Recurrent neural network) – искусственные нейронные сети, в которых выход нейрона может вновь подаваться на его вход. В более общем случае это означает возможность распространения сигнала от выходов к входам.

5. Обучение нейронных сетей

Одно из важнейших свойств нейронных сетей это способность обучаться на основе данных окружающей среды и в результате обучения повышать свою производительность. Обучение нейронной сети происходит посредством корректировки синаптических весов и порогов.

Можно дать следующее определение процессу обучения,с позиции нейронной сети :

Обучение – это процесс, в котором свободные параметры нейронной сети настраиваются посредством моделирования среды, в которую эта сеть встроена. Тип обучения определяется способом подстройки этих параметров.

Это определение процесса обучения нейронной сети предполагает следующую последовательность событий:

- В нейронную сеть поступают стимулы из внешней среды.

- В результате первого пункта изменяются свободные параметры нейронной сети.

- После изменения внутренней структуры нейронная сеть отвечает на возбуждения уже другим образом.

Вышеуказанный список четких правил решения проблемы обучения нейронной сети называется алгоритмом обучения.

Существуют два концептуальных подхода к обучению нейронных сетей: обучение с учителем и обучение без учителя.

Обучение нейронной сети с учителем предполагает, что для каждого входного вектора из обучающего множества существует требуемое значение выходного вектора, называемого целевым. Эти вектора образуют обучающую пару. Веса сети изменяют до тех пор, пока для каждого входного вектора не будет получен приемлемый уровень отклонения выходного вектора от целевого.

Обучение нейронной сети без учителя является намного более правдоподобной моделью обучения с точки зрения биологических корней искусственных нейронных сетей. Обучающее множество состоит лишь из входных векторов. Алгоритм обучения нейронной сети подстраивает веса сети так, чтобы получались согласованные выходные векторы, т.е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы.

II. Практическая часть

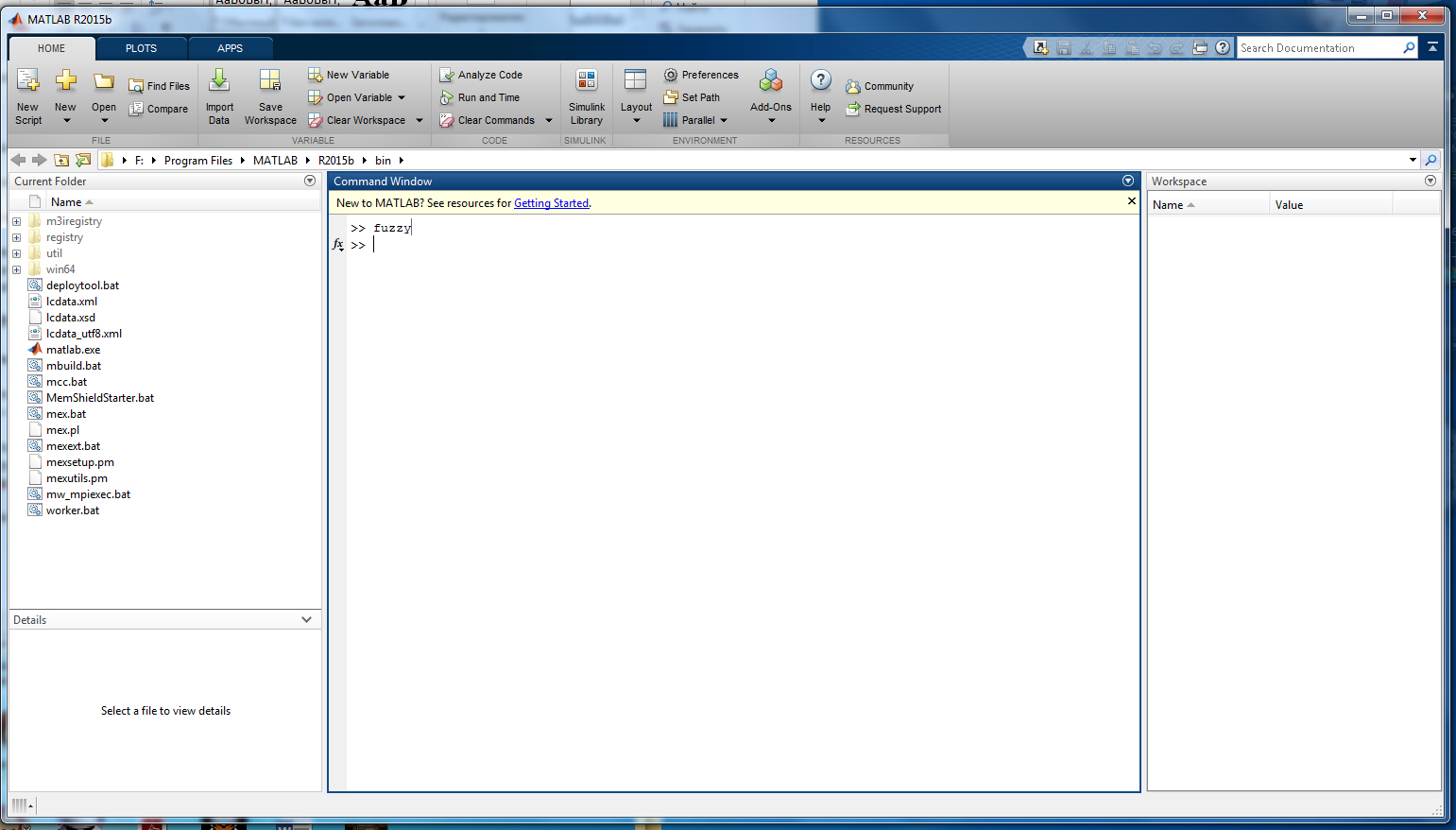

6. Применение нечеткой логики на практике

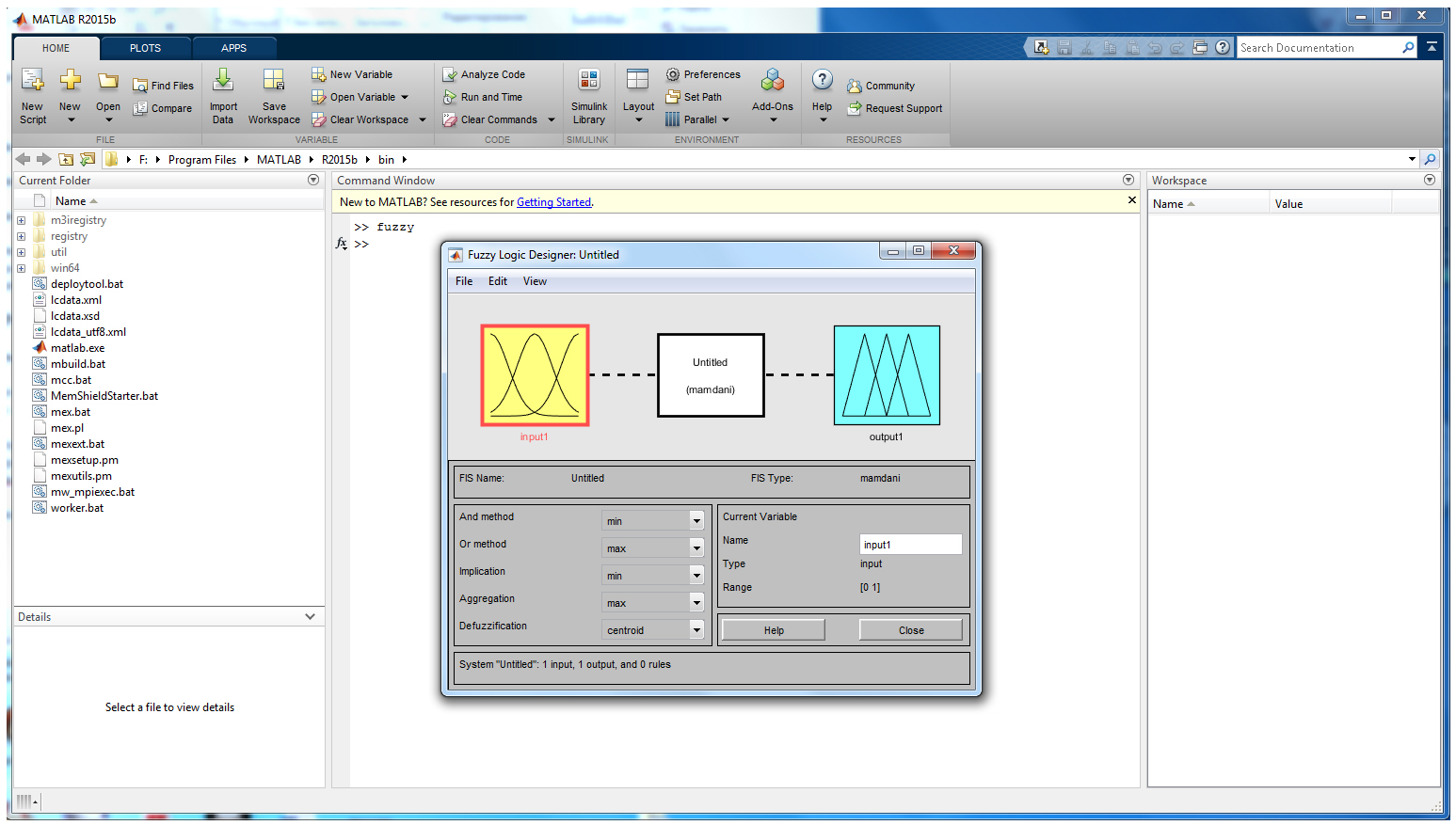

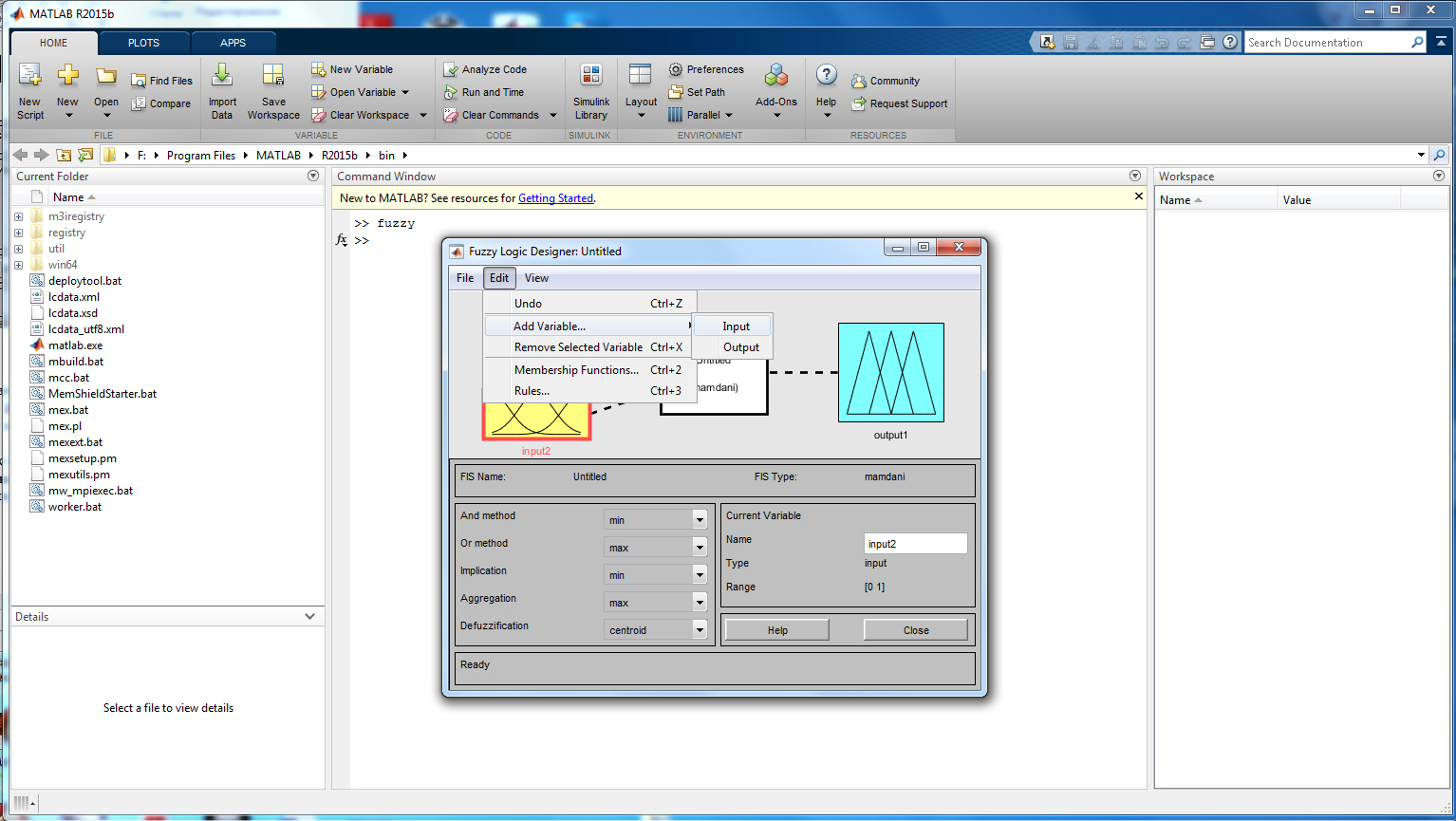

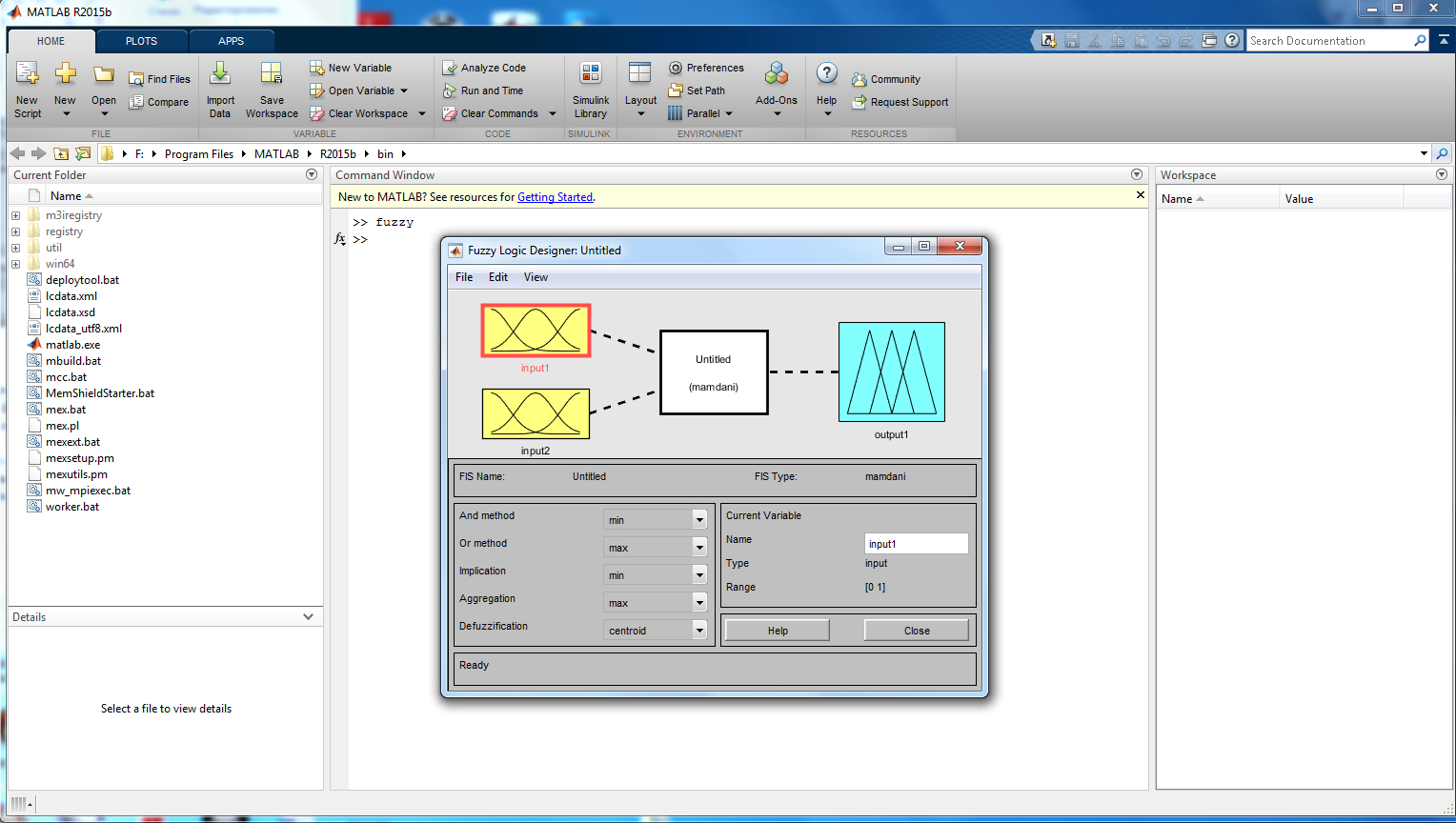

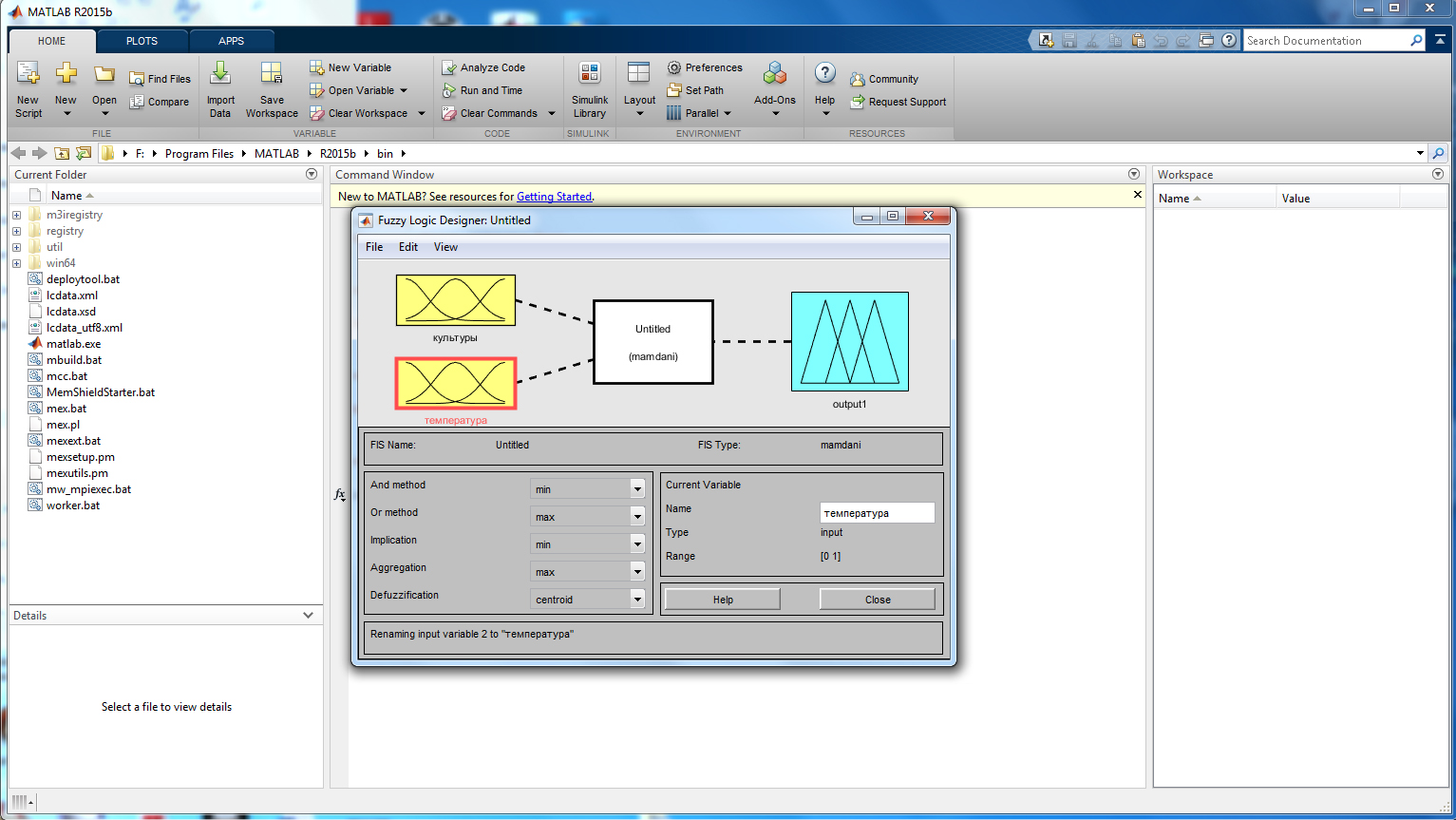

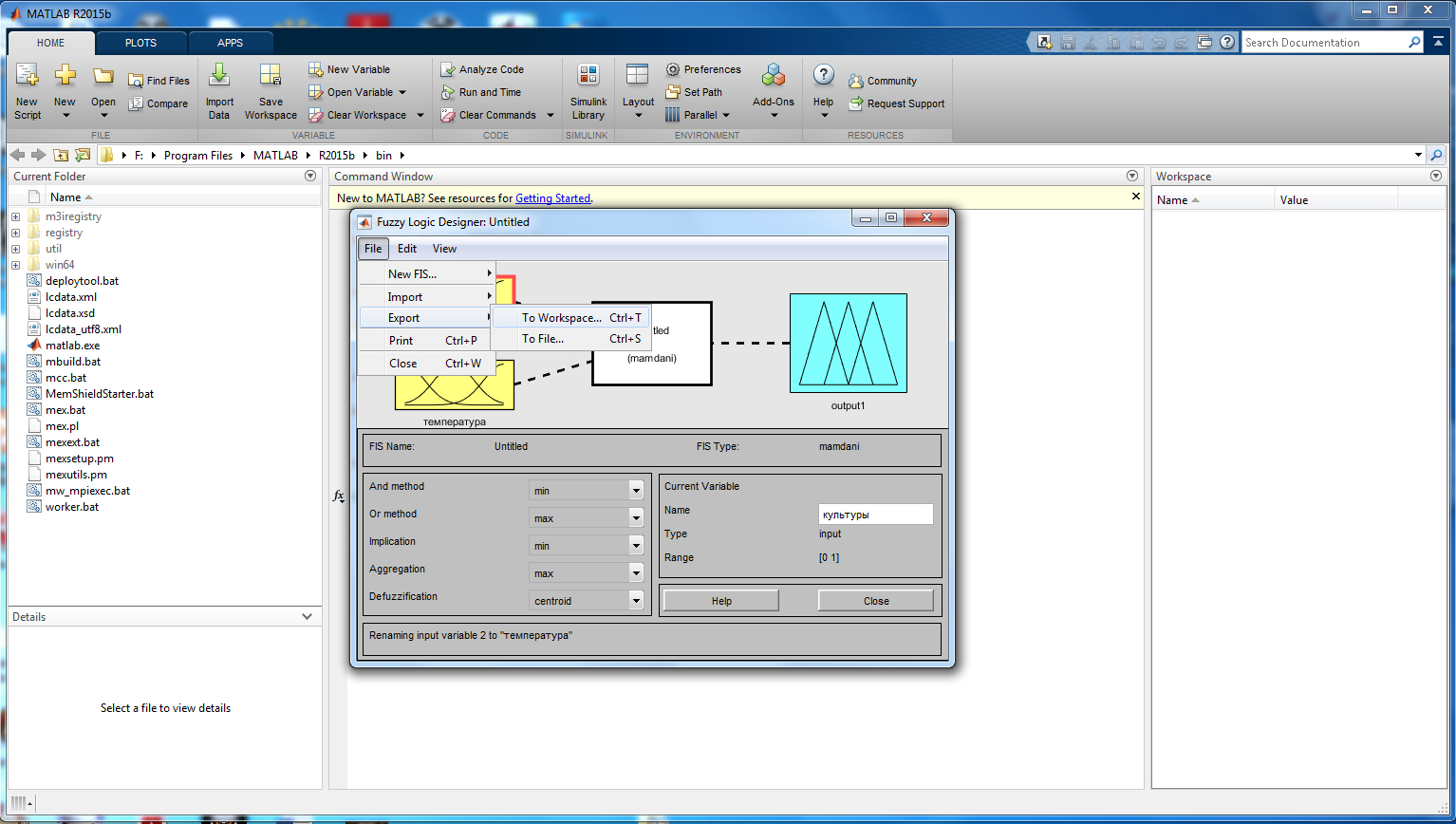

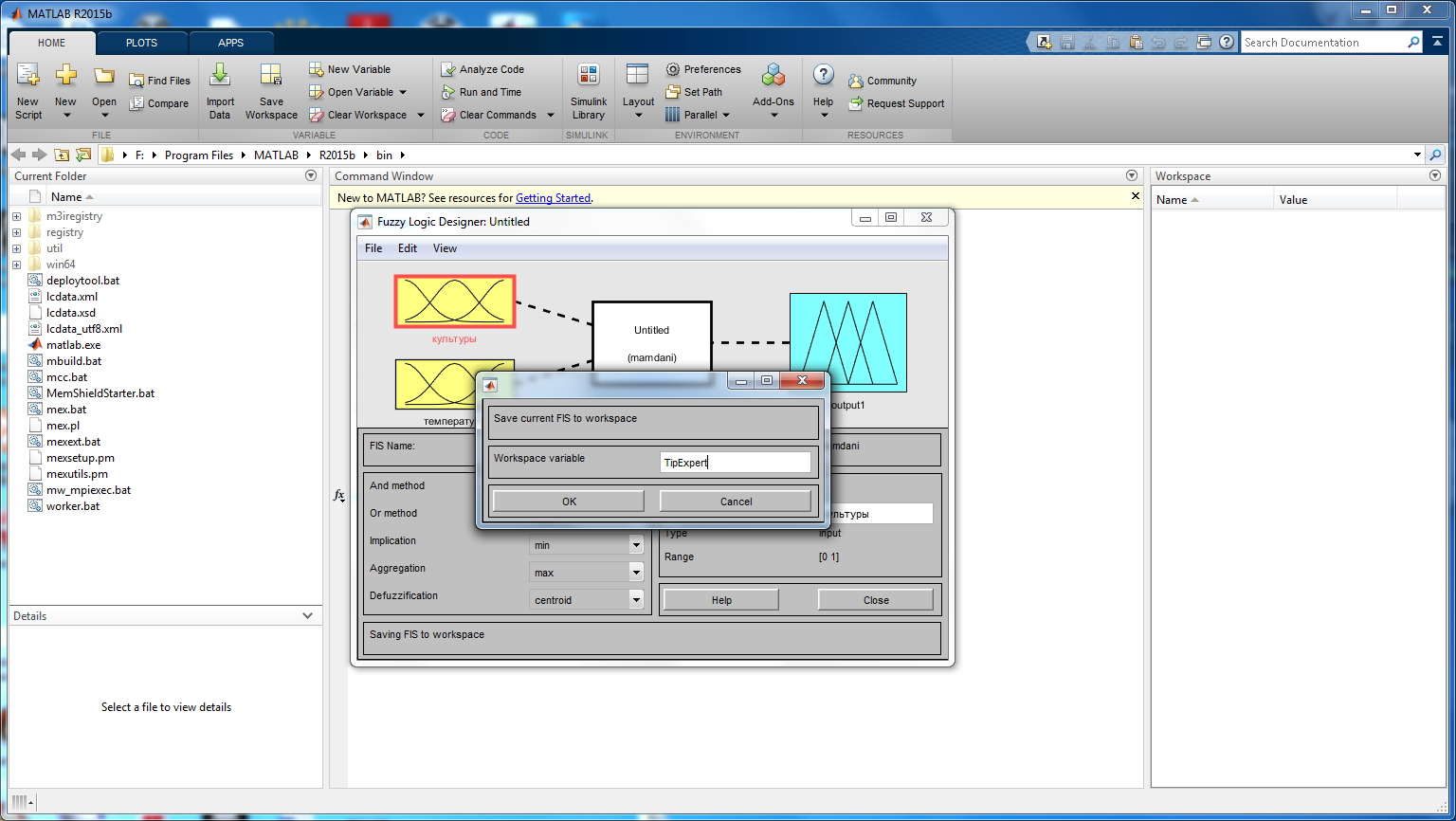

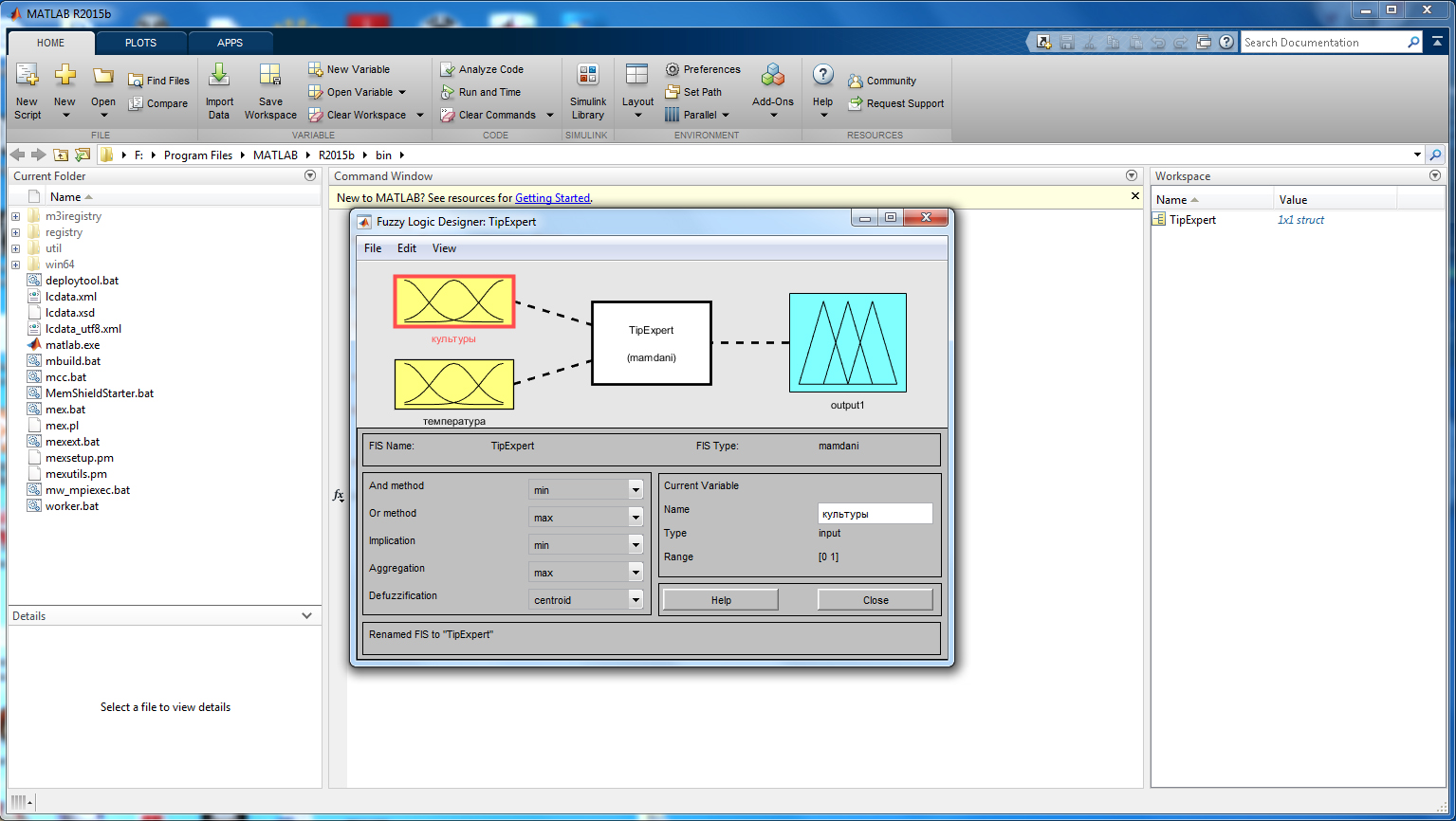

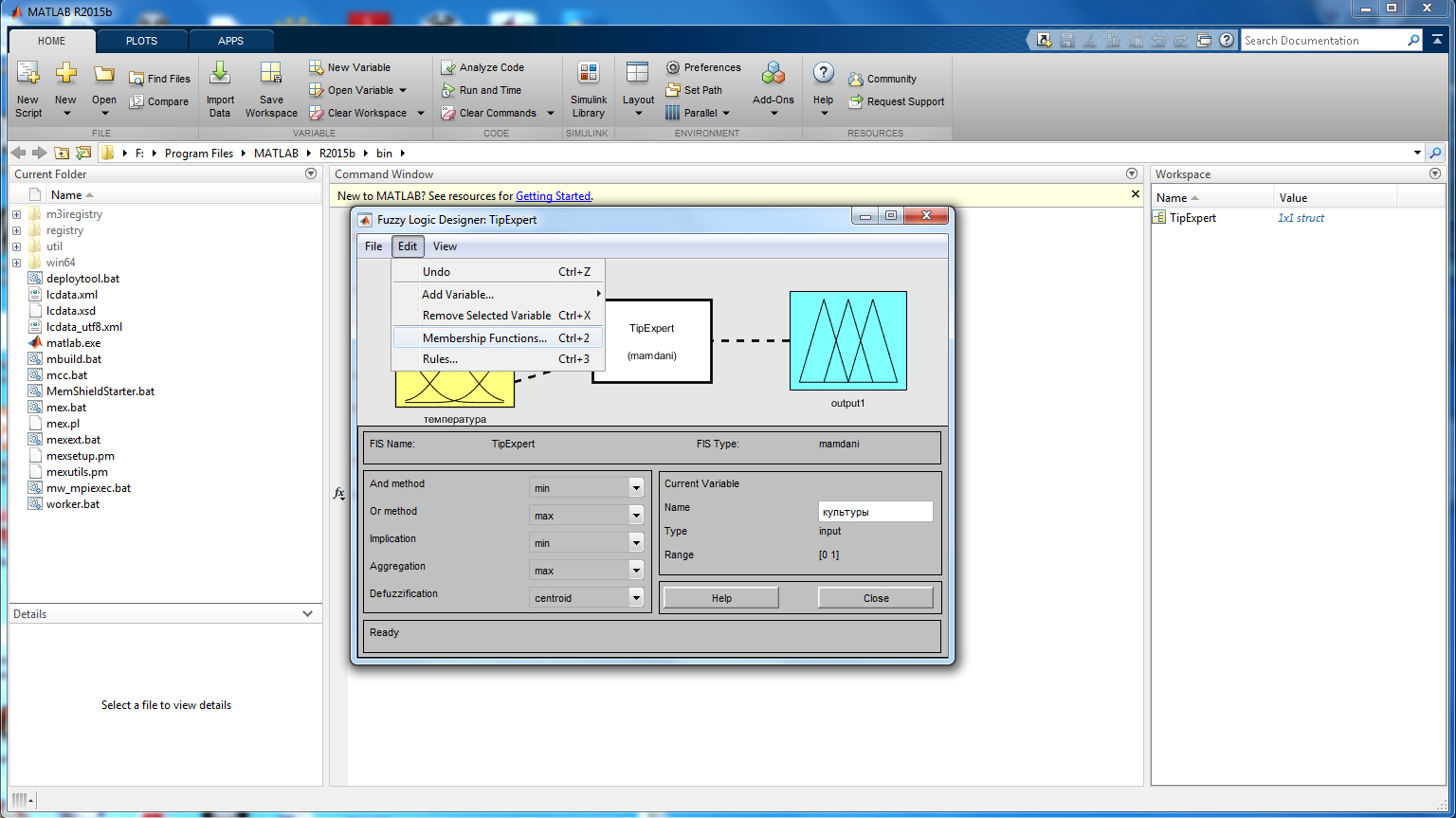

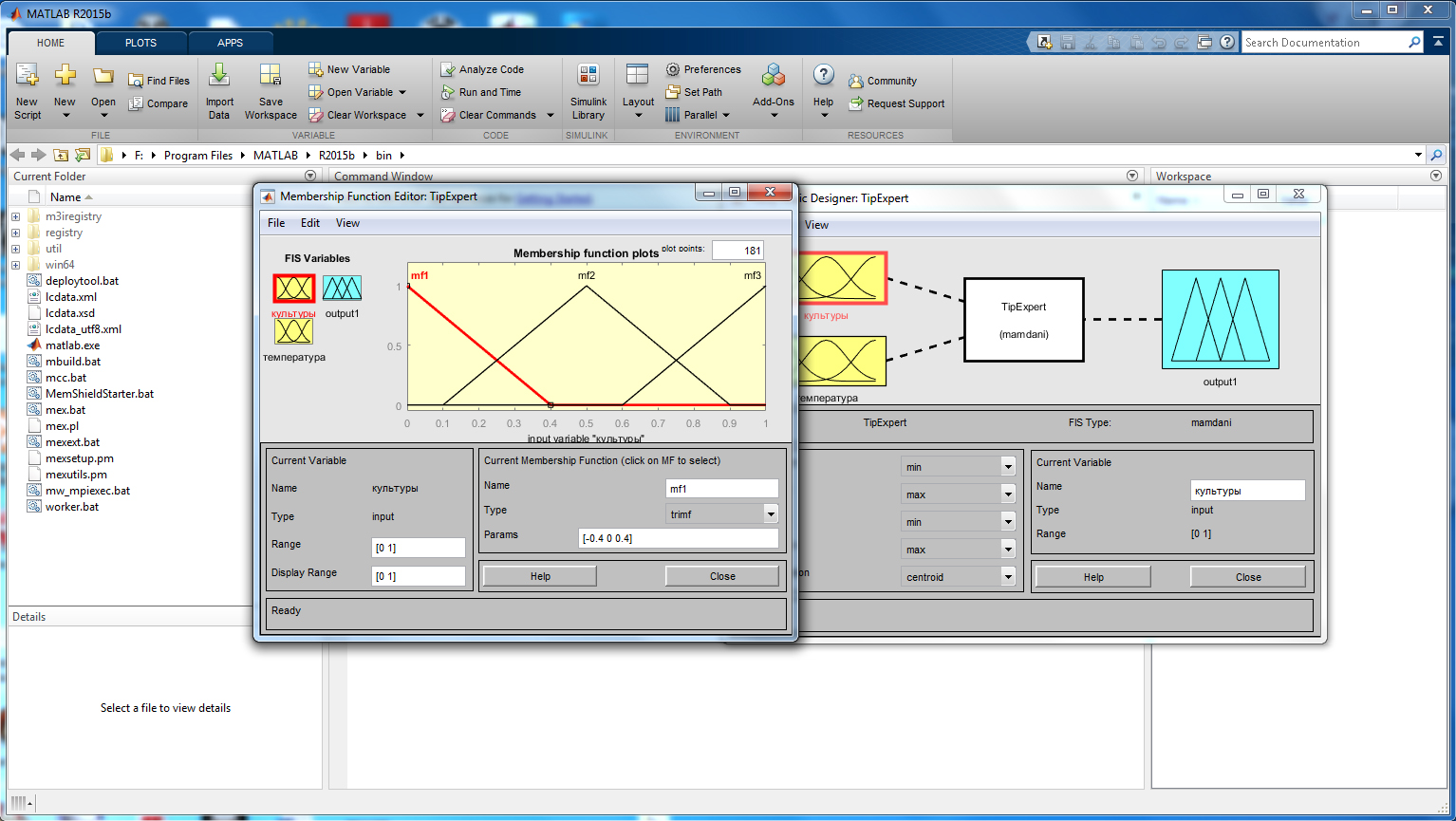

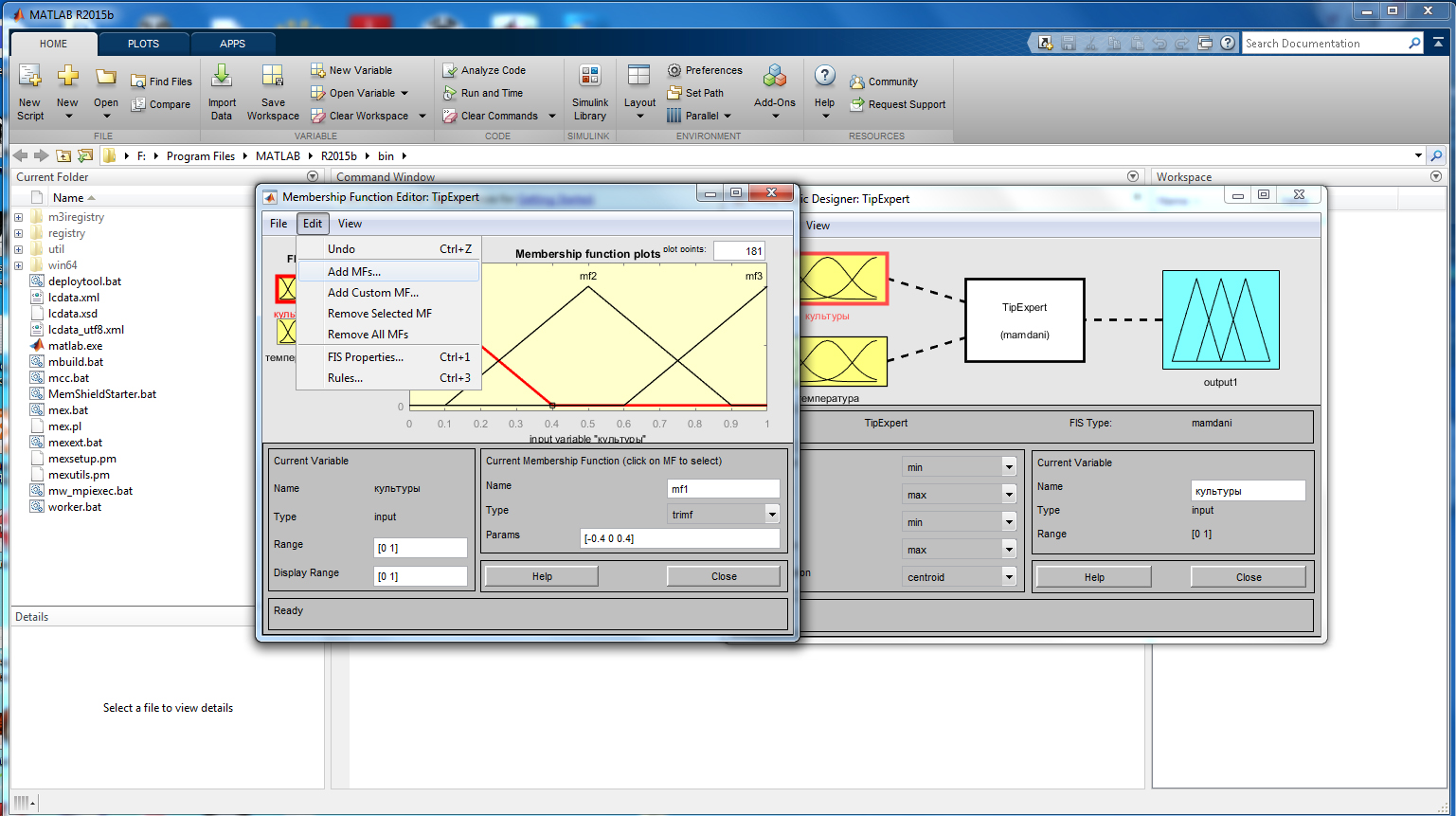

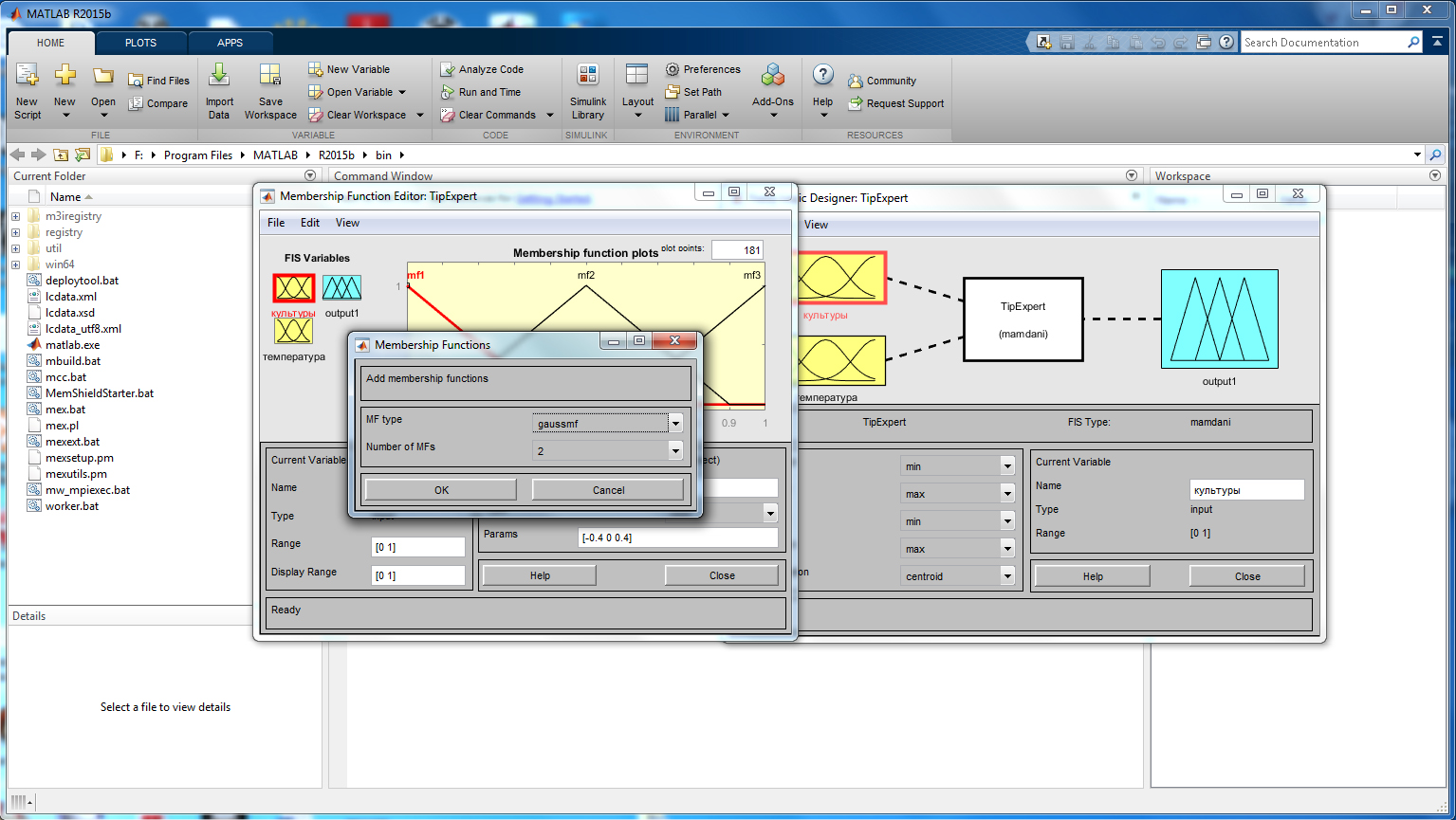

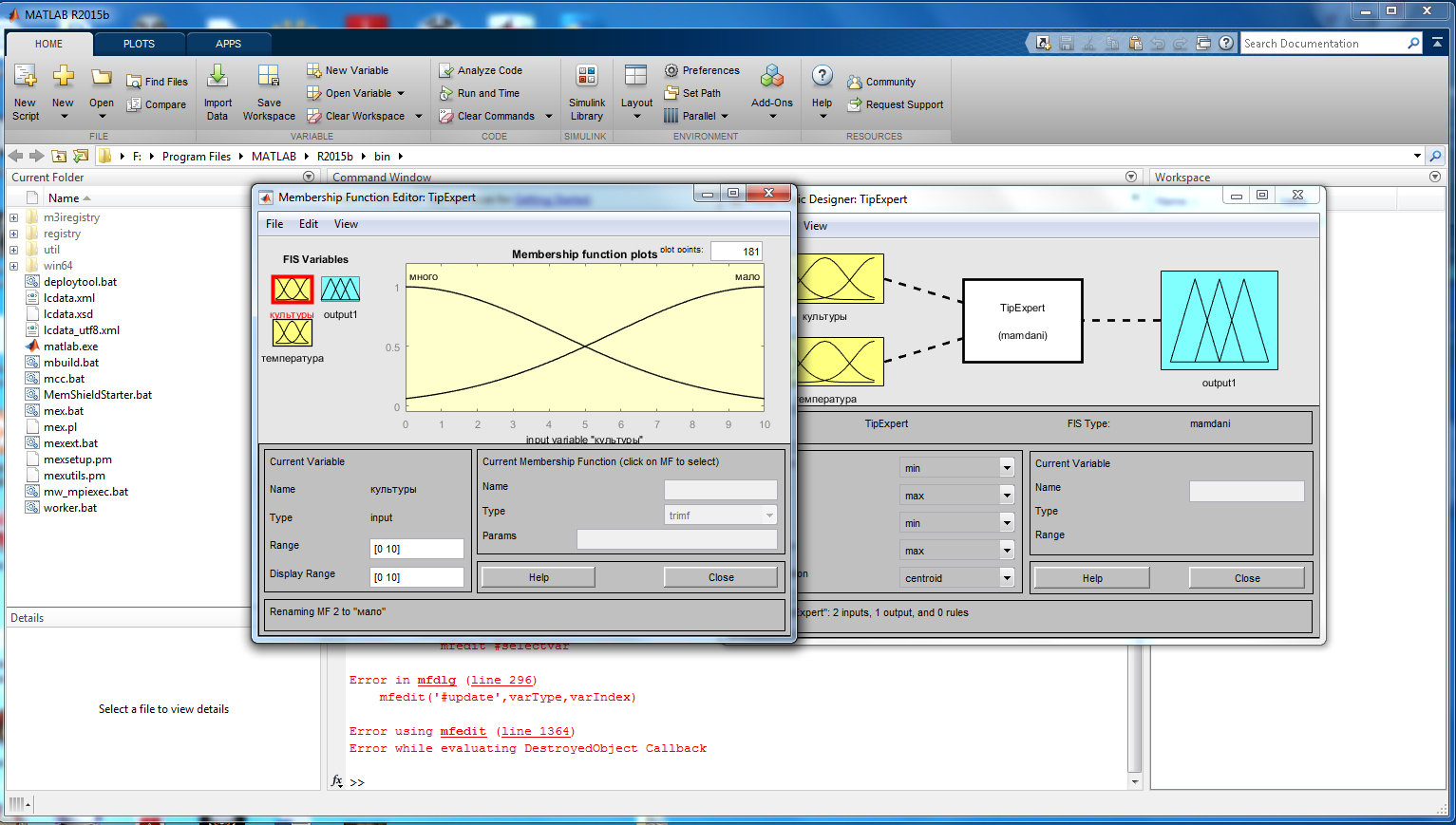

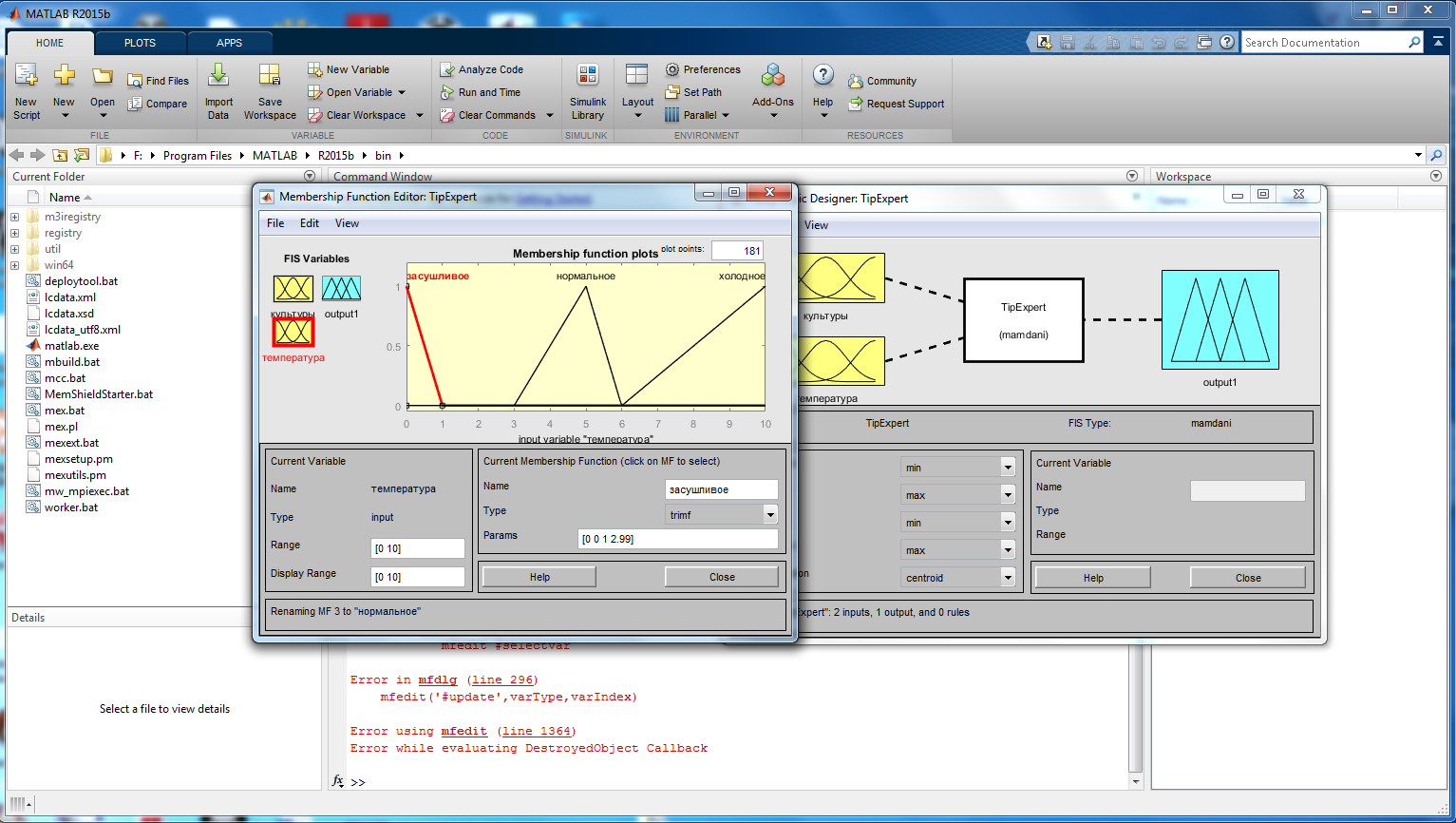

Задача на определение расхода воды на полив

В задаче требуется определить расход воды при поливе с/х угодий.

Входные сигналы: а) количество с/х культур (много культур, мало

культур), б) температура воздуха летом (засушливое лето,

нормальное лето, холодное лето). Выходной сигнал: расход воды на

полив (большой расход, средний расход, маленький расход).

Правила: 1. Если с/х культур много, лето засушливое, то расход

воды большой. 2. Если с/х культур много, лето нормальное, то

расход воды средний. 3. Если с/х культур мало, лето холодное, то

расход воды маленький.

Заключение

В данной работе даны представления об истории развития нейронных сетей, аналогии нейронных сетей с мозгом и биологическим нейроном , дано понятие искусственного нейрона.

Были рассмотрены виды искусственных нейронных сетей: однослойные, многослойные, а также feedforward сети и сети с обратными связями. Также было дано представление о том, что такое обучение сети с учителем и без учителя.

В практической части была решена задача, в которой наглядно было представлено практическое применение нейронных сетей.

Литература

- Мак-Каллок У.С., Питтс У. Логическое исчисление идей, относящихся к нервной активности // Автоматы, под ред. Шеннона К.Э. и Маккарти Дж. М.: ИЛ, 2003. С. 362 - 384.

- Розенблат Ф. Принципы нейродинамики. Перцептроны и теория механизмов мозга. Мир, 2004, 248 с.

- С. Короткий, "Нейронные сети: Алгоритм обратного распространения". СПб, 2002, 328 с.

- С. Короткий,"Нейронные сети: Основные положения. СПб, 2002. 357 с.

- Фон Нейман Дж. Вероятностная логика и синтез надежных организмов из ненадежных компонент. // Автоматы, под ред. Шеннона К.Э. и Маккарти Дж. М.: ИЛ, 2003, С. 68 - 139.

- Фон Нейман Дж. Теория самовоспроизводящихся автоматов. М.: Мир, 2001, 382 с.

- Фролов А.А., Муравьев И.П. Информационные характеристики нейронных сетей. М.: Наука, 2005, 160 с.

- Фролов А.А., Муравьев И.П. Нейронные модели ассоциативной памяти. М.: Наука, 2004, 160 с.

- Аппаратная платформа персонального компьютера

- «Проектный офис: принципы и этапы формирования» .

- Особенности составления и представления управленческой отчетности

- Налоговый учет расходов при реализации имущества

- Принципы подготовки и предоставления финансовой отчетности

- Банк России – как системообразующий элемент национальной банковской системы

- Бренд — конкурентное преимущество компании

- налоги и налогообложение

- Акцизы (Теоретические аспекты акцизного налогообложения)

- Разработка бизнес-плана инвестиционного проекта (на примере «Швейный мастер»)

- Конкуренция на российском рынке банковских услуг и пути её развития

- Роль лица, принимающего решения