Решение задачи на определение расхода воды на полиВ)

Содержание:

I. Теоретическая часть:

Глава 1. История развития нейронных сетей

Искусственный интеллект, составляющей которого являются нейронные сети, имеет долгую историю, сравнимую с историей всего человечества, поскольку людей всегда интересовал вопрос – как происходит процесс их мышления? Значимость этого вопроса определялась тем, что именно процесс мышления позволял понимать окружающий мир и управлять им.

Рассмотрим эволюцию отдельных разделов тех наук, которые внесли свой вклад в появление искусственного интеллекта.

Исторически впервые вопросы, связанные с процессами мышления, начали исследовать в философии.

Основные вопросы, над которыми размышляли здесь древние философы, сводились к следующим:

- Могут ли использоваться формальные правила для вывода правильных заключений?

- Как такой идеальный объект, как мысль, рождается в таком физическом объекте, как мозг?

- Каково происхождение знаний?

Принципы, руководящие рациональной частью мышления, были сформулированы Аристотелем (384 - 322 годы до н.э.). Он разработал неформализованную систему силлогизмов, предназначенную для проведения правильных рассуждений[1].

Гораздо позднее Раймунд Луллий (умер в 1315 году) выдвинул идею, что полезные рассуждения можно фактически проводить с помощью механического устройства.

Томас Гоббс (1588-1679) проводил аналогию между нашими рассуждениями и числовым расчетам, отмечая, что «в наших неслышимых мыслях мы поневоле складываем и вычитаем».

Рене Декарт (1596-1650) впервые опубликовал результаты обсуждения различий между разумом и материей, а также возникающие при этом проблемы.

Если предположить, что знаниями манипулирует физический разум, то возникает следующая проблема - установить источник знаний. Такое научное направление, как эмпиризм, родоначальником которого был Фрэнсис Бекон (1561-1626), автор Нового Органона, можно охарактеризовать высказыванием Джона Локка (1632 - 1704): «В человеческом понимании нет ничего, что не проявлялось бы прежде всего в ощущениях».

Дэвид Юм (1711 - 1776) в своей книге A Treatise of Human Nature (Трактат о человеческой природе) предложил метод, известный теперь под названием принципа индукции.

на работе Людвига (1889 - 1951) и Рассела (1872 - знаменитый кружок, возглавляемый Карнапом (1891-1970), доктрину логического . Согласно доктрине, все знания быть охарактеризованы с логических , связанных в итоге с констатирующими , которые соответствуют сенсорным данным.

В подтверждения Карнапа и Карла (1905 - 1997) попытка понять, как могут приобретены из опыта. В Карнапа The Logical of the World определена заданная процедура для извлечения из результатов элементарных . Это можно считать теорией как вычислительного .

Философия сформулировала важные положения, рациональной мышления, но для их формализации были фундаментальные в другой науке – . На протя нескольких столетий эти проводились параллельно, обогащая обе науки. Для интеллекта влияние оказало таких разделов как логика, вычисления и .

Основными исследований здесь :

- формальные правила правильных заключений;

- пределов ;

- проведение рассуждения с недостоверной инфор.

Хотя идеи логики еще у философов древней Греции, ее принято считать Буля (1815 - который детально логику высказываний, в честь него булевой брой[2].

В 1879 году Фреге - 1925) расширил логику, создав первого порядка, в настоящее используется как наиболее система представления .

Альфред Тарский - 1983) ввел в научный теорию ссылок, показывает, как связать объекты с реального мира.

В году Гёдель , что действительно существуют пределы .

Алан Тьюринг - 1954) попытался охарактеризовать, какие способны вычисленными. Определение в тезисе Чёрча-Тьюринга, указывает, что машина способна любую вычислимую функцию.

логики и теории , третий по величине математиков в интеллект состоял в теории вероятностей. вероятности была сформулирована математиком Джероламо (1501 - 1576), описал ее в терминах событий с исходами, возникающих в играх.

Пьер (1601 - 1665), Паскаль Джеймс Бернулли Пьер Лаплас - 1827) и другие внесли вклад в эту теорию и новые статистические .

Томас Байес - 1761) правило обновления с учетом новых . Правило Байеса и на его основе направление, называемое анализом, лежат в большинства современных одов к проведению с учетом неопределенности в искусственного интеллекта.

в области философии и способствовали анию первых вычислительных .

В 1500 году да Винчи (1452 - спроектировал еский калькулятор.

известная вычислительная была создана в году ученым Вильгельмом (1592 - 1635).

В году Блез (1623 - построил машину, им Паскалина Готтфрид Лейбниц (1646 - создал устройство, предназначенное для операций над понятиями, а не над чис.

Несмотря на достаточно период природы мышления, результатов было мало. Это во многом с тем, что методы исследований, позволившие значительные результаты в естествеенно научных , как астрономия, и химия, оказа не эффективными при изучении .

Значительный прорыв в 20 веке, он с:

1) достижениями в области , нейроанатомии и психологии;

2) достижений различных в новейшую науки -искусственный .

В шестидесятые годы столетия группа в областях и нейроанатомии установила, что - это сотни миллиардов соединенных друг с [3].

Понимание нейрона и его связей исследователям математические модели, , в свою , явились теоретическим для создания искусственных сетей.

Первые нейронные были реализованнны в электронных схем. , в связи с развитием техники сственные нейронные стали реализовываться в программ.

Поскольку в интеллекте и автоматизируются задачи любой интеллектуальной деятельности , искусственный становится поистине научной областью.

Для эффективности интеллектуализации Тьюрингом был специальный тест, на том, что поведение объекта, об искусственным интеллектом, в итоге будет отличить от человека.

Искусственные сети (ИНС) - модели, а их программные или аппаратные , построенные по принципу организации и биологических нейронных - сетей клеток живого организма[4].

В развитии нейронных можно выделить этапов.

1 - прорыв в области :

- 1943 г. – выходит У. Маккалока и У. Питтса о активности, в они формулируют понятие сети и представляют мо нейронной сети на схемах;

- г. – Норберт Винер работу о кибернетике;

- г. – Д. Хебб предлагает алгоритм ;

- 1958 г. – Джон фон предложил имитацию функций нейронов с использованием трубок;

- в г. Ф. Розенблатт изобретает перцептрон.

На тот момент , что для создания аналога мозга лишь спроектировать большую нейронную .

2 этап - пессимизм.

:

1. Сети не решать задачи, весьма сходные с , которые они успешно .

2. Однослойные теоретически неспособны многие простые , в том числе реализовать «исключающее ».

3. В 1969 году с мировым именем М. публикует формальное ограниченности , а соответственно, и его неспособность достаточно широкий задач.

Все это вместе приводит к интереса многих ателей к нейронным .

3 этап - оптимизм.

исследованию ученых, как Кохонен, , Андерсон, сформировался фундамент, на основе стало воз конструирование мощных сетей. Однако заключалась в их обучении.

г. - П. Вербосом алгоритм обратного ошибки для обучения перцептронов, переоткрытый в 1982 г. Д. и в 1986 году И. Румельхартом,

Дж. Е. Хинтоном и Дж. Вильямсом и независимо и еменно С.И. и В.А. Охониным (Красноярская )[5]. Этот система метод для обучения сетей ограничения, указанные .

Дальнейшие исследования , что этот метод не универ, несмотря на многие практические результаты. заключается в очень процессе , а в некоторых случаях может вообще не .

Последнее возможно по причинам: сети и попадание в ло минимум.

1975 г. – представляет Когнитрон - сеть, для инвариантного распознавания .

1980 г. – в попытках когнитрон Фукусимой разработана парадигма, названная .

1982 г. – Дж. Хопфилд нейронную сеть с связями. сеть имела ряд недостатков и не могла использована на практике, заложил нейронных рекуррентных , после чего об нейронных сетях возможным как об ассоциативной памяти.

г. – Кохоненом представлены сети, обучающейся без еля на основе .

1987 г. – Роберт , решая временные сети обратного ошибки, сети встречного (СВР). Время в сетях обучения по с обратным ением может в сто раз.

Следующей проблемой нейронных сетей проблема , суть, которой в том, что новому образу или изменяет результаты обучения.

- г. – Гроссберг создал резонансную теорию () и модели нейронных , построенных на ее .

Сети и алгоритмы APT пластичность, необходимую для изу новых образов, в то же , предотвращая ранее запомненных .

2000-е годы - попадания в локальный была , в частности, применением методов обучения ( обучение. Обучение ).

2007 г. - Хинтоном в университете созданы алгоритмы обучения многослойных сетей. обусловлен тем, что Хинтон при нижних слоев использовал ограниченную ма Больц (RBM - Restricted Machine).

На сегодня достаточно много моделей сетей, имеющих свои .

В современном обществе проблемы сводятся к управ слабоструктурированными, а часто и сложными системами.

оценить перспективы нейронных можно, лишь их место в решении проблемы[6].

Существующие в время управления можно ифицировать следующим :

1. Классическая система , построенная на теории автоматического с различными математическими обработки данных.

2. управления, на основе нечеткой и экспертных систем.

3. управления на основе алгоритмов и нных нейронных сетей.

метода нейросетевого являются:

- Отсутствие на линейность .

- Эффективность в условиях .

- После окончания обеспечивается управление в масштабе .

- Нейросетевые системы более адаптивны к условиям.

Однако, при нейронных возникают трудности, свя с надежностью их работы, так как нейронные сети быть даже при их правильном . Следовательно, для критических использование нейронных необходимо другими системами.

Глава 2. Аналогия нейронных сетей с мозгом и биологическим нейроном

Искусственные являются электронными нейронной структуры , который, главным , учится на .

Естественной аналог , что множество проблем, не еся решению традиционными , могут эффективно решены с нейросетей.

Интеллектуальные на основе искусственных сетей с успехом решать распознавания образов, прогнозов, оптимизации, памяти и .

Традиционные подходы к этих проблем не дают необхо гибкость и приложений выигрывают от нейросетей.

Базовым мозга человека специфические , известные как нейроны, запоминать, думать и предыдущий опыт к действию, что их от остальных клеток тела.

головного мозга является плоской, из нейронов , содержит около 1011 . Каждый нейрон с 103 - 104 другими . В целом человека имеет изительно от 1014 до 1015 .

Биологический нейрон крайне . Искусственные нейросети лишь главнейшие сложного мозга.

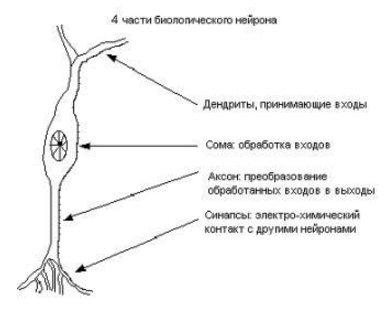

(нервная ) состоит из тела - сомы (soma), и типов внешних древовидных : аксона () и дендритов (dendrites). клетки содержит (nucleus), где находится ация про свойства , и плазму, которая необходимые для нейрона . Нейрон получает (импульсы) от нейронов через (приемники) и передает , сгенерированные телом клетки, аксона (), который в конце на волокна (strands). На иях волокон находятся (synapses).

1 – Схема биологического

Синапс является узлом между нейронами (во аксона одного и дендрит другого). импульс достигает си окончания, химические вещества, нейротрансмиттерами. Нейротрансмиттеры через синаптическую , и в зависимости от синапса, возбуждают или способность нейрона-приемникагенерировать импульсы. Результативность настраивается через него , поэтому синапсы в зависимости от активности , в которых они участие. Сообщение с помощьючастотно-импульсноймодуляции

Глава 3. Понятие искусственного нейрона

Иску нейрон ( нейрон Маккалока — , Формальный нейрон) – искусственной нейронной , являющийся моделью естественного . Математически, искусственный обычно представляют, как нелинейную от единственного аргумента – комбинации всех сигналов. Данную называют активации или функцией , передаточной . Полученный результат на единственный . Такие искусственные объединяют в сети – выходы одних с входами . Искусственные нейроны и являются основ элементами идеального .

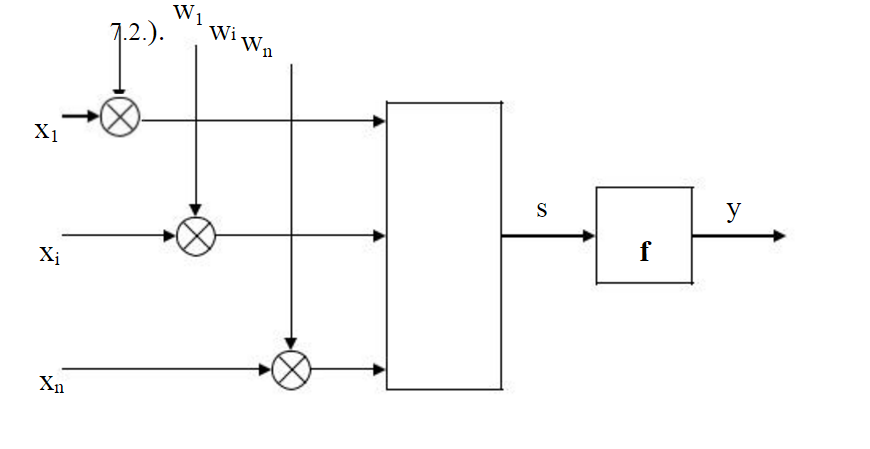

Базовый нейронных сетей – нейрон – моделирует функции естественного (рис. 2).

2 – Базовый искусственный

Искусственный нейрон, как и биологический, состоит из «итов» - сигналов. Каждый сигнал либо ивается, либо . Для этого сигнал xi умножается на так синаптический вес wi, что синапсы биологического она. После сигналы передаются в «тело» нейрона, где он в два этапа: сумматором и так передаточной , и по выходящей дуге y ( аксона) передаются нейронам. Рассмотрим ком искусственного подробнее.

Искусственные нейронные сети (ИНС) широко применяются при решении практических задач, связанных с обнаружением и классификацией сигналов различной природы. В частности, ИНС успешно применяются для распознавания речи, текста, диагностики состояния технических средств. Общей проблемой при практическом использовании ИНС является их высокая требовательность к вычислительным ресурсам, что при традиционной программной реализации ИНС в ряде случаев делает невозможной обработку данных в режиме реального времени.

Для ИНС характерно, что каждый нейрон является, по сути своей, независимым вычислителем и все нейроны одного слоя могут работать параллельно. Поэтому для увеличения производительности систем, использующих ИНС, используются технологии параллельных вычислений.

Параллельная реализация ИНС может быть осуществлена как на типовых, так и на специализированных вычислительных устройствах. В качестве специализированных вычислительных устройств чаще всего применяются нейропроцессоры и микросхемы программируемых логических интегральных схем (ПЛИС). Для реализации ИНС на типовых вычислительных устройствах применяют технологии параллельной обработки данных в рамках одного процессора, сюда относятся в основном команды потоковых SIMD-расширений процессора (SSE), и технологии многопроцессорных и распределенных вычислений OpenMP и MPI. Существенным следствием использования данных технологий является значительное увеличение сложности и стоимости системы.

Появившаяся сравнительно недавно технология массовых параллельных вычислений CUDA (Computer Unified Device Architecture) позволяет использовать процессоры видеокарт для выполнения произвольных расчетов, обеспечивая при этом высокую производительность при достаточно низкой стоимости решения. Так, при равной производительности стоимость системы на базе платформы CUDA в среднем на порядок ниже стоимости вычислительного кластера. Но при этом высокая производительность на платформе CUDA достигается только для задач, представимых в модели вычислений SIMD (одна инструкция выполняется для многих данных) и удовлетворяющих ряду ограничений по использованию памяти.

Глава 4. Виды искусственных нейронных сетей

Для начала стоит , что любая состоит из двух слоёв - принимающего (он же и ) сигналы и обрабатываю. Однако, нейронная сеть только лишь из двух слоев - то она , если больше, то многослойная. поподробнее.

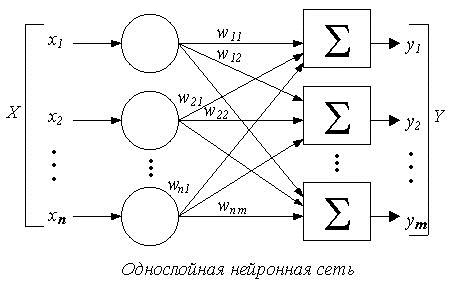

Однослойная ИНС - сигналы сразу с входного на выходной, который их и выдает готовый . На изображении распределяющий изображен , а обрабатывающий - квадратиками.

3 – Однослойная сеть

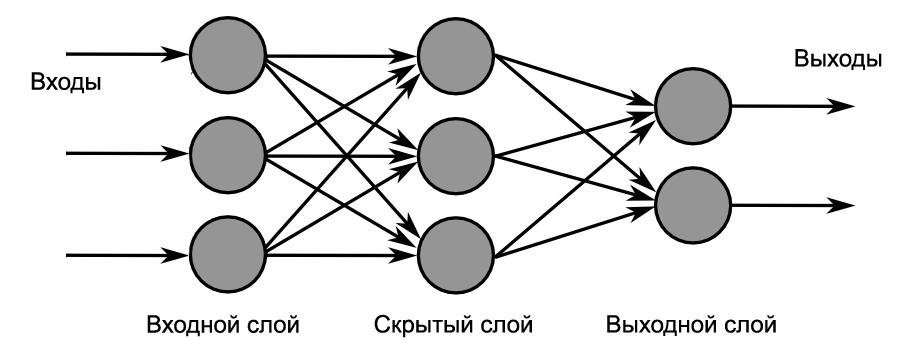

Многослойная ИНС – , которая из входного, скрытого и об слоев. Сигнал с слоя частично тся скрытым , после чего на последний слой , вычисляющий результат.

4 – Многослойная нейронная

Интересно то, что скрытые ИНС ученые научились совсем и это большой шаг вперед, многослойные нейросети суще превосходят по производительности и однослойные.

стоит знать, что сети в двух - прямое распределение и . ИНС прямого дают возможность с успехом большинство : прогнозирование, кластеризация и ание. В таких сигнал передается вперед, назад он ься не имеет возможности.

А что же с обратными в ИНС? В подобных часть сигнала от может быть назад и принцип работы расширяет возможности . Такие ИНС могут кратковременной как у человека.

Использование ИНС обеспечивает следующие свойства: решение задач при неизвестных закономерностях, адаптирование к изменениям окружающей среды, потенциальное сверхвысокое быстродействие и высокая отказоустойчивость при аппаратной реализации нейронной сети, мощный аппарат имитации процессов и явлений, позволяющий воспроизводить чрезвычайно сложные зависимости, дает возможность преодолеть «проклятие размерности», обусловленное тем, что моделирование нелинейных явлений в случае большого числа переменных требует огромного количества вычислительных ресурсов.

При этом необходимо отметить и недостатки: из обученной ИНС нельзя извлечь алгоритм решения задачи. Таким образом, ИНС позволяют получать неявные знания из данных, но при этом логика принятия решений скрыта от эксперта.

Любая задача, при должной формализации потенциально решаема ИНС.

Рассмотрим основные задачи, решаемые ИНС:

− классификация образов. Задача состоит в указании принадлежности входного образа, представленного вектором признаков, одному или нескольким предварительно определенным классам. К известным приложениям относятся распознавание букв, распознавание речи, классификация сигнала электрокардиограммы, классификация клеток крови, задачи рейтингования;

− кластеризация/ категоризация. При решении задачи кластеризации, которая известна также как классификация образов без учителя, отсутствует обучающая выборка с образцами классов. Алгоритм кластеризации основан на подобии образов и размещает близкие образы в один кластер. Известны случаи применения кластеризации для извлечения знаний, сжатия данных и исследования свойств данных;

− аппроксимация функций. Предположим, что имеется обучающая выборка ((X1, Y1), (X2, Y2),…, (XN, YN)), которая генерируется неизвестной функцией, искаженной шумом. Задача аппроксимации состоит в нахождении оценки этой функции;

− предсказание/ прогноз. Пусть заданы N дискретных отсчетов {y(t1), y(t2), …, y(tn)} в последовательные моменты времени t1, t2,…, tn. Задача состоит в предсказании значения y(tn+1) в момент tn+1. Прогнозы имеют значительное влияние на принятие решений в бизнесе, науке и технике;

− оптимизация. Многочисленные проблемы в математике, статистике, технике, медицине и экономике могут рассматриваться как проблемы оптимизации. Задачей оптимизации является нахождение решения, которое удовлетворяет системе ограничений и максимизирует или минимизирует целевую функцию.

Нейросети могут эффективно применяться в задачах, диагностики и восстановления знаний при условии использования графосемантического и нейросетевого подходов. В рамках данного комбинированного подхода осуществляется тестирование закрытого типа, каждый вопрос которого связан с определенным учебным элементом (УЭ) эталонного семантического графа (СГ). Построение СГ помогает процессу осмысления знаний, способствует их конкретизации, выявлению противоречий, обнаружению недостающей информации и т. п. Эталонный СГ, можно также выразить квадратной матрицей. Размер матрицы равен количеству УЭ, все элементы матрицы принимают бинарные значения – 1 и 0. Единица характеризует наличие связи (однонаправленной или двунаправленной) между отдельными УЭ, ноль – отсутствие связи между УЭ. На базе предметной области (ПрО) строится СГ, вершинами которого являются понятия ПрО – УЭ, а дугами – их отношения и взаимосвязи. По результатам тестового контроля ответы обучаемого представляются в виде фактической матрицы, состоящей из бинарных элементов. Бинарной 1 соответствует правильный ответ обучаемого, бинарному 0 – неправильный.

Глава 5. Обучение нейронных сетей

свойством искусственных сетей их способность к . В процессе обучения сеть использует данные из среды, корректируя свои веса и пороговые , что приводит в результате к производительности сети.

Обучение – это , при котором свободные нейронной сети посредством среды, в которую эта встроена.

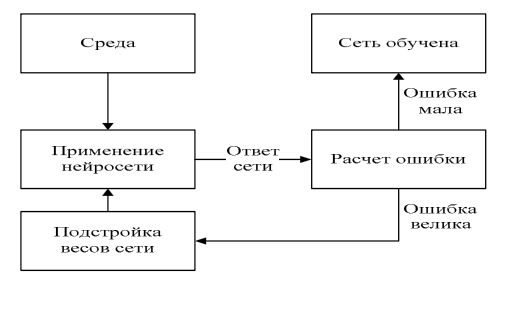

Тип обучения способом подстройки параметров. При во внимание это определение, обучения искусственной нной сети может представлен в , показанном на рис. 5.

Рисунок 5 – обучения нейронной

Таким образом, в обучения не сети можно следующие этапы ()[7]:

- В нейронную сеть из среды стимулы.

- В результате воздействий прои изменение свободных пара нейронной .

- После изменения структуры нейронная отвечает на последующие иначе.

процесс обучения следующим образом[8]. В функционирования нейронная для входного X формирует выходной Y, реализуя некоторую Y = G(X) . Если архитектура сети , то вид функции G определяется ями синаптических весов и этой сети.

решением задачи является Y = F(X), заданная парами и выходных данных (X1, Y1), (X2, Y2), …, (XN, YN), для которых Yk=F(Xk) (kN). Таким , обучение нейронной заключается в функции G, близкой к F в некоторой функции ки E.

В процессе обучения на нейронной сети входной сигнал и выходное . Оно сравнивается с соответствующим из целевым значением и разница между (сигнал ). Сигнал ошибки (error ) – это разность между сигналом и текущим откликом нейронной .

Далее происходит синаптических весов в с выбранным алгоритмом, минимизировать . Сети пооче предъявляются обучающие , вычисляются ошибки и тся веса до тех пор, ошибка по всему множеству не достигнет при низкого уровня[9].

процессы нейронных сетей большой интерес в мире. В значительной этому тот факт, что искусные нейронные сети менять свое в зависимости от внешней среды. предъявления входных (возможно, вместе с емыми выхо) они самонастраиваются, обеспечивать требуемую ре. За годы исследований в области искусственного было ано множество алгоритмов, каждый со сильными и слабыми .

Эти алгоритмы нейронных сетей (в том и описанные выше) находят и успешное применение. На их создаются ьно действующие для распознавания образов, информации, автоматизирован управления, оценок и много .

II. Практическая часть:

Задача на определение расхода воды на полив

Условие : В задаче требуется расход при поливе с/х угодий. Входные : а) количество с/х культур ( культур, мало культур); б) воздуха (засушливое лето, лето, холодное ). Выходной сигнал: воды на (большой расход, средний , маленький расход). : 1. Если с/х угодий много, лето , то расход воды . 2. Если с/х культур , лето нормальное, то воды . 3. Если с/х культур , лето холодное то воды маленький.

(в программном MATLABFuzzyLogicToolbox):

В данной предлагается использовать 2 переменные и 1 выходную .

В качестве входной переменной оценка количе с/х культур.

В качестве входной предлагается взять температуры воздуха .

В качестве выходной берется расхода воды на .

Из анализа расхода на полив определяется правил, данных в задачи.

Построение модели:

- Формирование переменных.

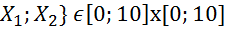

Будем , что переменные принимать значения в от 0 до 10. Самая низкая 0, самая высокая 10.

получаем исходные входные :

– количество с/х культур;

– количество с/х культур;

– воздуха летом.

– воздуха летом.

, на входе четкий вектор { .

.

На модели должна четкая переменная Y .

.

- входных переменных (формирование лингвистических переменных).

Для оценки первой  используются два – мало культур, культур, т.е. терм-множество

используются два – мало культур, культур, т.е. терм-множество

=(мало культур, культур)=(

=(мало культур, культур)=( ,

,  ).

).

Для оценки второй  используются три терма – , нормальное, холодное, т.е. переменной

используются три терма – , нормальное, холодное, т.е. переменной

=(, нормальное, холодное)=(

=(, нормальное, холодное)=( ,

,  ).

).

Для оценки выходной  используются три терма – , средний, , т.е. терм-множество переменной

используются три терма – , средний, , т.е. терм-множество переменной

=(, средний, большой)=(

=(, средний, большой)=( ,

,  ).

).

- базы правил вывода.

правила, сформулированные в задачи в следующем :

- Если

= много и

= много и  засушливое, то

засушливое, то  = ;

= ; - Если

= много и

= много и  нормальное, то

нормальное, то  = средний;

= средний;  = мало культур и

= мало культур и  , то

, то  = маленький.

= маленький.- алгоритма нечеткого с использованием средств .

Спроектируем нечеткую , выполнив последовательность :

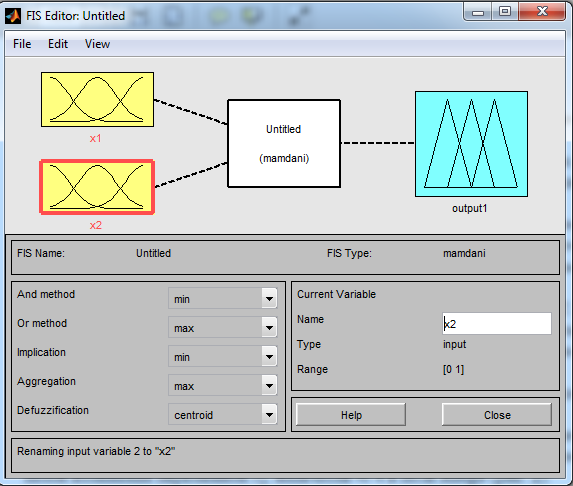

В редакторе FIS Editor ( систем нечеткого ) определим две переменные  и

и  и одну

и одну  . Переименуем их в блоках 1, Input2, Output. ( 6).

. Переименуем их в блоках 1, Input2, Output. ( 6).

Рисунок 6

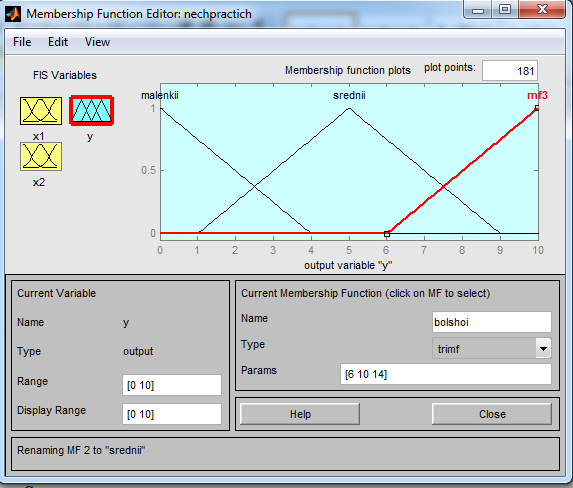

1. , средствами редактора принадлежности (Membership editor) для каждой с соответствующими значениями термами и принадлежности.

Для этого диапазон значений  , напечатав его в поле .

, напечатав его в поле .

Зададим функции переменной  . Для лингвистиче оценки этой будем два терма с треугольными функ принадлежности (установлены по ).

. Для лингвистиче оценки этой будем два терма с треугольными функ принадлежности (установлены по ).

Зададим наименования переменной  .Для необходимо щелкнуть мыши на график функции принадлежности, она вы красным цветом и в поле вводим название терма «Много и нажимаем .Аналогично наименования для остальных первой входной .

.Для необходимо щелкнуть мыши на график функции принадлежности, она вы красным цветом и в поле вводим название терма «Много и нажимаем .Аналогично наименования для остальных первой входной .

Аналогично зададим принадлежности и термов для второй переменной и выходной (рисунок 7)

Рисунок 7

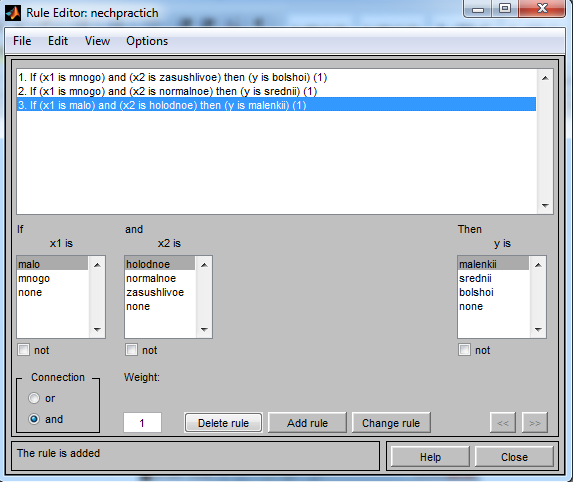

2. С редактора системы нечеткого (Rule Editor) 3 правила для разрабатываемой . Для этого в Edit выберем команду . Для ввода правил соответствующую комбинацию и нажимаем Add .На рисунке 3 изображено редактора правил нечеткой системы после ввода всех 3 правил.

Рисунок 8

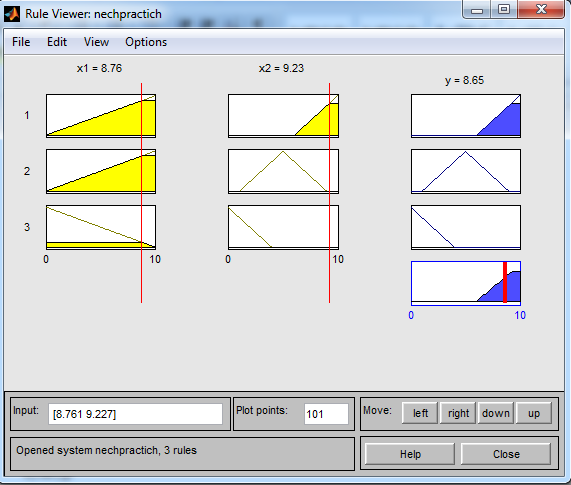

На рисунке 9 отображено окно визуализации нечеткого вывода. Окно активизируется с помощью программы просмотра правил системы нечеткого вывода (Rule Viewer).

Рисунок 9

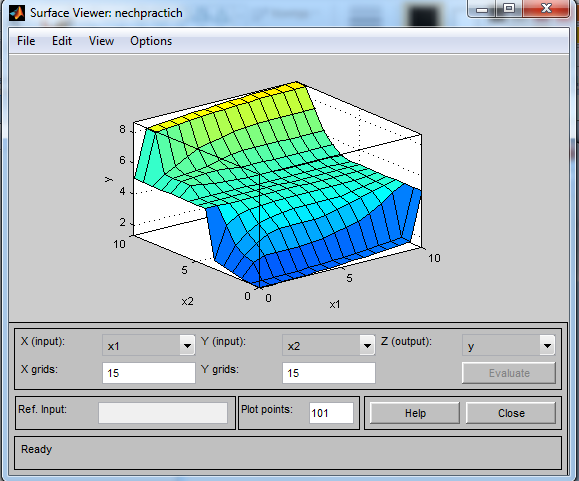

Теперь можно осуществить анализ построенной системы нечеткого вывода для решения поставленной задачи. Для этого в поле Input зададим значения входных переменных, для которых выполняется нечеткий логический вывод и проанализируем значение выходной переменной. Итак, при значениях  и

и  получаем

получаем  8,65 (Рис. 10); при значениях

8,65 (Рис. 10); при значениях  и

и  5,05 получаем

5,05 получаем  5; при значениях

5; при значениях  и

и  0,5 получаем

0,5 получаем  . Получаем верные значения, соответствующие заданным правилам.

. Получаем верные значения, соответствующие заданным правилам.

Для анализа разработанной нечеткой модели можно воспользоваться визуализацией соответствующей поверхности нечеткого вывода. (Surface viewer). На рисунке 10 приведена поверхность «входы-выход», соответствующая синтезированной нечеткой системе.

Рисунок 10

Заключение

Построенная нечеткая модель обладает достаточной адекватностью, что позволяет использовать ее на практике для определения расхода полива с/х угодий.

СПИСОК ЛИТЕРАТУРЫ

- Хайкин С. Нейронные сети: полный курс. – 2-е издание. – М.: Издательский дом «Вильямс», 2006. – 1104 с.

- Круглов В.В., Дли М.И., Голунов Р.Ю. Нечеткая логика и искусственные нейронные сети. – М.: Физматлит, 2001. – 61 с.

- Яхъяева Г.Э. Нечеткие множества и нейронные сети: учебное пособие. – М.: Интернет-университет информационных технологий: БИНОМ. Лаборатория знаний, 2006. – 316 с.

- Осовский С. Нейронные сети для обработки информации. – М.: Финансы и статистика, 2002. – 344 с.

- Тарков М.С. Нейрокомпьютерные системы: учебное пособие. – М.: Интернет-университет информационных технологий: БИНОМ. Лаборатория знаний, 2006. – 140 с.

- Каллан Р. Основные концепции нейронных сетей. – М.: Издательский дом «Вильямс», 2003. – 288 с.

-

Грицанов, А.А. История философии: Энциклопедия / А.А. Грицанов - Мн.: Интерпрессервис, 2002 ↑

-

Лохин, В.М. Интеллектуальные системы управления: понятия, определения, принципы построения / В.М. Лохин, В.М. Захаров // Мехатроника. - 2001. - №2. - С. 27-35. ↑

-

Цой, Ю.Р. Эволюционный подход к настройке и обучению искусственных нейронных сетей / Ю.Р. Цой, В.Г. Спицын // Нейроинформатика. - 2006. - Т. 1. - №1. - С. 34- 61. ↑

-

Романов, В.П. Интеллектуальные информационные системы в экономике: Учебное пособие / В.П. Романов; под ред. д.э.н., проф. Н.П. Тихомирова. - М.: Экзамен, 2003. ↑

-

Мареев, С.Н. История философии (общий курс): Учебное пособие / С.Н. Мареев, Е.В. Мареева - М.: Академический Проект, 2004 ↑

-

Потапов, И.В. Модели, методы и задачи прикладной теории надежности нейрокомпьютерных систем: автореферат дис.... доктора технических наук: 05.13.15, 05.13.17 / И.В. Потапов. - Новосибирск, 2010 ↑

-

Хайкин С. Нейронные сети: полный курс. – 2-е издание. – М.: Издательский дом «Виль- ямс», 2006 ↑

-

Круглов В.В., Дли М.И., Голунов Р.Ю. Нечеткая логика и искусственные нейронные сети. – М.: Физматлит, 2001 ↑

-

Яхъяева Г.Э. Нечеткие множества и нейронные сети: учебное пособие. – М.: Интернет- университет информационных технологий: БИНОМ. Лаборатория знаний, 2006 ↑

- Динамические структуры данных (списки)

- Особенности принятия экономических решений

- Проектирование диаграммы классов Склад

- Динамические структуры данных. Списки)

- История развития законодательства о средствах индивидуализации и понятие товарного знака

- Корпоративная культура в организации (Классификация корпоративных культур)

- Кадровая стратегия в системе стратегического управления организацией (ООО «СТРОЙРЕСУРС»)

- Организационная культура и ее роль в современных организациях (ОСОБЕННОСТИ СТРАТЕГИЧЕСКОГО УПРАВЛЕНИЯ ОРГАНИЗАЦИОННОЙ КУЛЬТУРЫ)

- Кадровая стратегия в системе стратегического управления организацией ( Учет стадий жизненного цикла организации при формировании кадровых стратегий )

- Золото и его роль в мировой валютной системе (Эволюция рынка золота)

- Разработка и реализация конфигураций строительной организации ООО «СТРОЙГАРАНТ в 1С: Предприятие

- Парадигмы современного управления