Нечеткая логика и нейронные сети (Понятие искусственного нейрона)

Содержание:

Введение

Данная курсовая работа посвящена предмету «Нечеткая логика и нейронные сети», в ней мы постараемся рассказать о том как появились нейронные сети и какие их виды существуют на данный момент.

Также будет решена практическая задача с помощью программы «MATLABFuzzyLogicToolbox» на произведение расчетов исходя из условий задачи.

В настоящее время человек пытается автоматизировать много очень сложных процессов из различных областей науки и производства. При этом все больше становится известно о мышлении человека, о нервной системе живых организмов, а также о механизмах эволюции живых существ. Всё это отражается на подходах к автоматизации. Каждый такой подход влечет за собой появление новых технологий. По всему миру активно развиваются алгоритмы, позволяющие строить нейронные сети, алгоритмы нечеткой логики, а также эволюционный метод поиска оптимальных решений. Все они взаимодействуют между собой и дополняют друг друга. На вершине такого взаимодействия стоит искусственный интеллект. Программное обеспечение, написанное с применением этих алгоритмов, применяется во всех областях техники и технологии.

Глава 1. История развития нейронных сетей

Термин «нейронная сеть» появился в середине XX века. Первые работы, в которых были получены основные результаты в данном направлении, были проделаны Мак-Каллоком и Питтсом. В 1943 году ими была разработана компьютерная модель нейронной сети на основе математических алгоритмов и теории деятельности головного мозга. Они выдвинули предположение, что нейроны можно упрощённо рассматривать как устройства, оперирующие двоичными числами, и назвали эту модель «пороговой логикой». Подобно своему биологическому прототипу нейроны Мак-Каллока–Питтса были способны обучаться путём подстройки параметров, описывающих синаптическую проводимость. Исследователи предложили конструкцию сети из электронных нейронов и показали, что подобная сеть может выполнять практически любые вообразимые числовые или логические операции. Мак-Каллок и Питтс предположили, что такая сеть в состоянии также обучаться, распознавать образы, обобщать, т. е. обладает всеми чертами интеллекта.[1]

Предоставленная модель заложила почвы 2-ух всевозможных раскладов изучений нейронных сеток. Раз расклад был нацелен именно на исследование био процессов в головном мозге, иной – на использование нейронных сеток как способа искусственного происхождения разума для заключения всевозможных прикладных задач. В 1949 году канадский физиолог и психолог Хебб высказал идеи о характере соединения нейронов мозга и их взаимодействии. Он первым предположил, что обучение заключается в первую очередь в изменениях силы синаптических связей. Теория Хебба считается типичным случаем самообучения, при котором испытуемая система спонтанно обучается выполнять поставленную задачу без вмешательства со стороны экспериментатора. В более поздних вариантах теория Хебба легла в основу описания явления долговременной потенциации.

В 1954 году в Массачусетском технологическом институте с использованием компьютеров Фарли и Кларк разработали имитацию сети Хебба. Также исследования нейронных сетей с помощью компьютерного моделирования были проведены Рочестером, Холландом, Хебитом и Дудой в 1956 году.[2]

В 1957 году Розенблаттом были разработаны математическая и компьютерная модели восприятия инфы мозгом на базе двухслойной обучающейся нейронной сети. При обучении предоставленная сеть воспользовалась арифметические воздействия склады и вычитания. Розенблатт обрисовал еще схему не лишь только главного перцептрона, но и схему закономерного склады. В 1958 году им была предложена модель электрического прибора, которое надлежит было имитировать процессы людского мышления, а 2 года через была продемонстрирована 1-ая деятельная автомат, которая имела возможность выучиться узнавать кое-какие из букв, написанных на карточках, которые подносили к его «глазам», навевающим воспоминания кинокамеры.

Интерес к исследованию нейронных сетей угас после публикации работы по машинному обучению Минского и Пейперта в 1969 году. Ими были обнаружены основные вычислительные проблемы, возникающие при компьютерной реализации искусственных нейронных сетей. Первая проблема состояла в том, что однослойные нейронные сети не могли совершать «сложение по модулю 2», то есть реализовать функцию «Исключающее ИЛИ». Второй важной проблемой было то, что компьютеры не обладали достаточной вычислительной мощностью, чтобы эффективно обрабатывать огромный объём вычислений, необходимый для больших нейронных сетей.

Исследования нейронных сетей замедлились до того времени, когда компьютеры достигли больших вычислительных мощностей. Одним из важных шагов, стимулировавших дальнейшие исследования, стала разработка в 1975 году Вербосом метода обратного распространения ошибки, который позволил эффективно решать задачу обучения многослойных сетей и решить проблему со «сложением по модулю 2».

В 1975 году Фукусимой был разработан когнитрон, который стал одной из первых имеющих несколько слоев нейронных сеток. Фактическая конструкция сети и способы, применяемые в когнитроне для опции условных весов связей, варьировались от одной стратегии к иной. Любая из стратегий имела собственные выдающиеся качества и дефекты. Сети имели возможность раздавать информацию лишь только в одном направленности или же перекидывать информацию из 1-го конца в иной, пока не активизировались все узлы и сеть не приходила в конечное положение. Добиться двусторонней передачи инфы меж нейронами получилось только в сети Хопфилда (1982), и специализация данных узлов для определенных целей была введена в первых гибридных сетях.Алгоритм параллельной распределённой обработки данных в середине 1980 годов стал популярен под названием коннективизма. В 1986 году в работе Руммельхарта и Мак-Клелланда коннективизм был использован для компьютерного моделирования нейронных процессов.

Не обращая внимания на большущий азарт, вызванный в научном обществе разработкой способа оборотного распространения промахи, это еще породило бессчетные дискуссии о том, имеет возможность ли это изучение быть на самом деле продано в головном мозге. В некоторой степени это связывали с тем, собственно что устройство оборотного прохождения сигнала не был бесспорным в то время, например как не было очевидного источника обучающего и мотивированного сигналов. Что не наименее, в 2006 году было предложено некоторое количество неконтролируемых процедур изучения нейронных сеток с одним или же несколькими слоями с внедрением например именуемых алгоритмов основательного изучения. Эти методы имеют все шансы быть применены для исследования промежных представлений, как с выходным сигналом, например и без него, дабы взять в толк главные особенности рассредотачивания сенсорных сигналов, поступающих на любой слой нейронной сети.

Как и во многих других случаях, задачи высокой сложности требуют применения не одного, а нескольких методов решения или их синтеза. Не исключение и искусственные нейронные сети. С самого начала нынешнего столетия в работах различных исследователей активно описываются нейро-нечёткие сети, ячеечно-нейросетевые модели. Также нейронные сети используются, например, для настройки параметров нечётких систем управления. В общем, нет никаких сомнений и в дальнейшей интеграции методов искусственного интеллекта между собой и с другими методами решения задач.

Глава 2. Аналогия нейронных сетей с мозгом и биологическим нейроном.

Развитие искусственных нейронных сетей вдохновляется биологией. То есть рассматривая сетевые конфигурации и алгоритмы, исследователи мыслят их в терминах организации мозговой деятельности. Но на этом аналогия может и закончиться. Наши знания о работе мозга столь ограничены, что мало бы нашлось руководящих ориентиров для тех, кто стал бы ему подражать. Поэтому разработчикам сетей приходится выходить за пределы современных биологических знаний в поисках структур, способных выполнять полезные функции. Во многих случаях это приводит к необходимости отказа от биологического правдоподобия, мозг становится просто метафорой, и создаются сети, невозможные в живой материи или требующие неправдоподобно больших допущений об анатомии и функционировании мозга.[3]

Несмотря на то, что связь с биологией слаба и зачастую несущественна, искусственные нейронные сети продолжают сравниваться с мозгом. Их функционирование часто напоминает человеческое познание, поэтому трудно избежать этой аналогии. К сожалению, такие сравнения неплодотворны и создают неоправданные ожидания, неизбежно ведущие к разочарованию. Исследовательский энтузиазм, основанный на ложных надеждах, может испариться, столкнувшись с суровой действительностью, как это уже однажды было в шестидесятые годы, и многообещающая область снова придет в упадок, если не будет соблюдаться необходимая сдержанность.[4]

Не обращая внимания на изготовленные предупреждения, здорово все же аристократия кое-что о нервозной системе млекопитающих, например как она благополучно постановляет задачки, к выполнению коих только желают искусственного происхождения системы. Нервная система человека, построенная из составляющих, именуемых нейронами, содержит обескураживающую сложность. В пределах 1011 нейронов принимают участие в приблизительно 1015 передающих связях, имеющих длину метр и больше. Любой нейрон владеет почти всеми свойствами, совместными с другими веществами тела, но его оригинальной возможностью считается способ, обработка и предоставление химических сигналов по нервозным путям, которые образуют коммуникационную систему мозга.

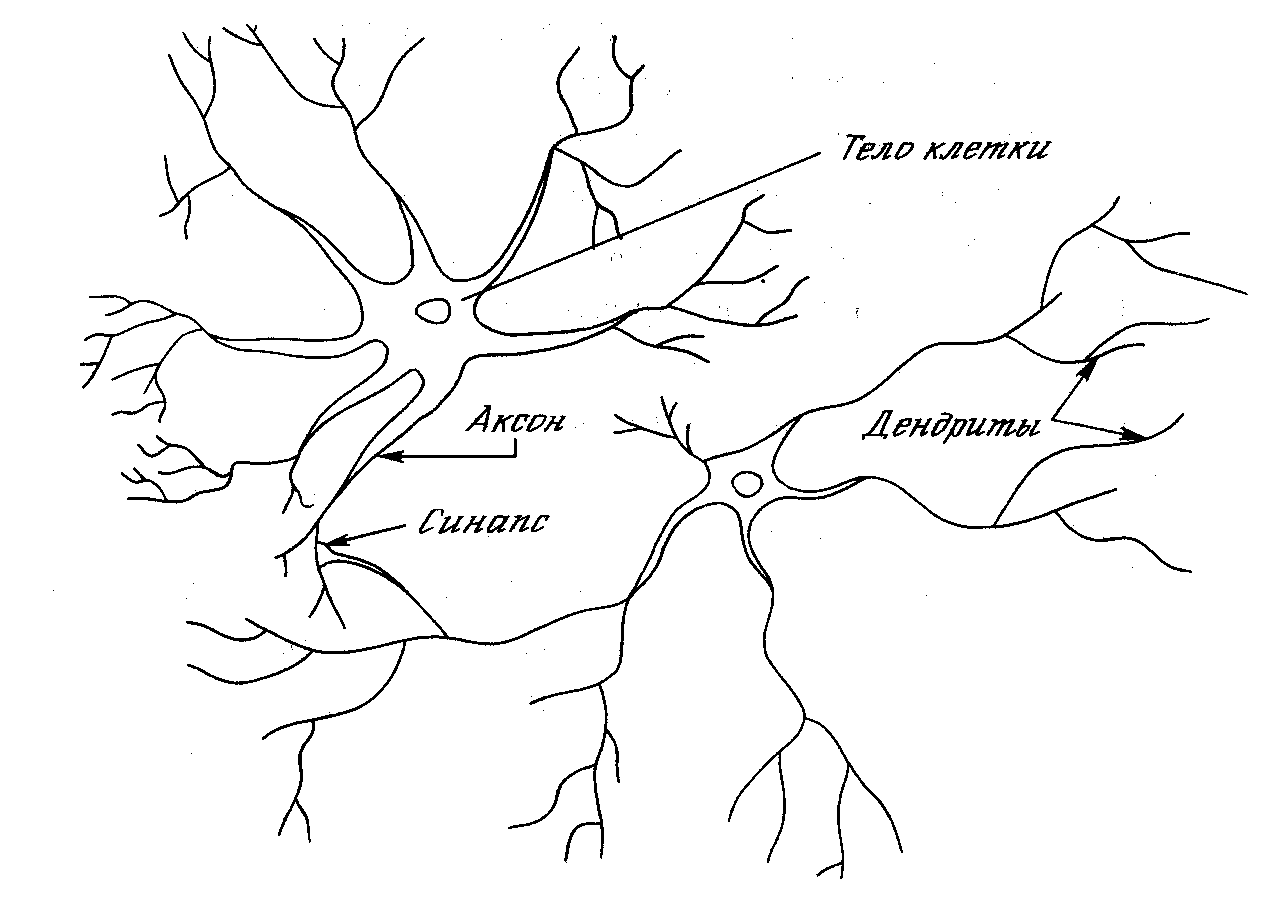

Рис. 1 Биологический нейрон

На рис. 1 показана структура пары типичных биологических нейронов. Дендриты идут от тела нервной клетки к другим нейронам, где они принимают сигналы в точках соединения, называемых синапсами. Принятые синапсом входные сигналы подводятся к телу нейрона. Здесь они суммируются, причем одни входы стремятся возбудить нейрон, другие – воспрепятствовать его возбуждению. Когда суммарное возбуждение в теле нейрона превышает некоторый порог, нейрон возбуждается, посылая по аксону сигнал другим нейронам. У этой основной функциональной схемы много усложнений и исключений, тем не менее большинство искусственных нейронных сетей моделируют лишь эти простые свойства.[5]

Глава 3. Понятие искусственного нейрона

Искусственный нейрон имитирует в первом приближении свойства биологического нейрона.

На вход искусственного происхождения нейрона поступает кое-какое большоеколичество сигналов, любой из коих считается выходом иного нейрона. Любой вход множится на сообразный вес, подобный синаптической мощи, и все произведения суммируются, определяя степень активации нейрона.

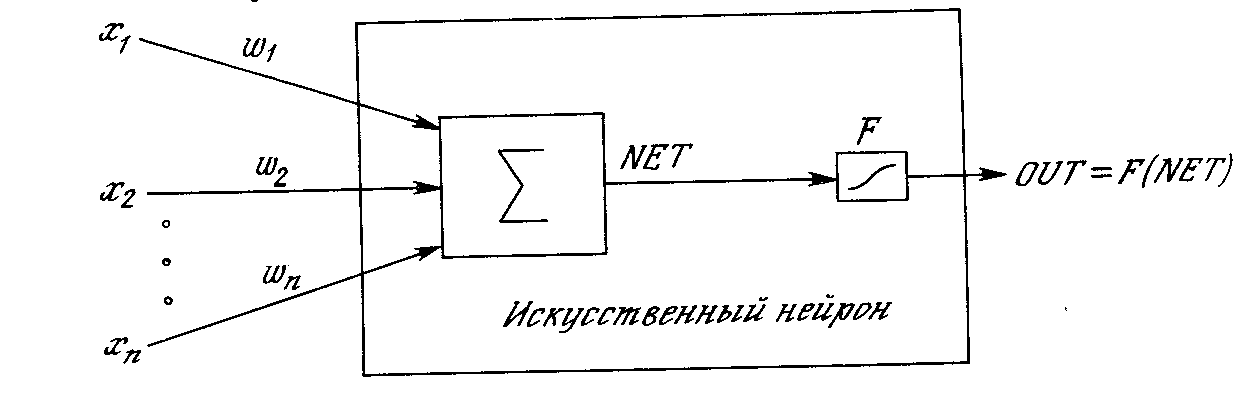

На рис. 2 представлена модель, реализующая эту идею. Хотя сетевые парадигмы весьма разнообразны, в основе почти всех их лежит эта конфигурация. Здесь множество входных сигналов, обозначенных x1, x2,…, xn, поступает на искусственный нейрон. Эти входные сигналы, в совокупности обозначаемые вектором X, соответствуют сигналам, приходящим в синапсы биологического нейрона. Каждый сигнал умножается на соответствующий вес w1, w2,…, wn, и поступает на суммирующий блок, обозначенный Σ. Каждый вес соответствует «силе» одной биологической синаптической связи. (Множество весов в совокупности обозначается вектором W.) Суммирующий блок, соответствующий телу биологического элемента, складывает взвешенные входы алгебраически, создавая выход, который мы будем называть NET.[6] В векторных обозначениях это может быть компактно записано следующим образом:

NET = XW.

Активационные функции

Сигнал NET далее, как правило, преобразуется активационной функцией F и дает выходной нейронный сигнал OUT. Активационная функция может быть обычной линейной функцией

OUT = K(NET),

Где К – постоянная, пороговой функции

OUT=1,если NET>T, OUT = 0 в остальных случаях,

где Т – некоторая постоянная пороговая величина, или же функцией, более точно моделирующей нелинейную передаточную характеристику биологического нейрона и представляющей нейронной сети большие возможности.[7]

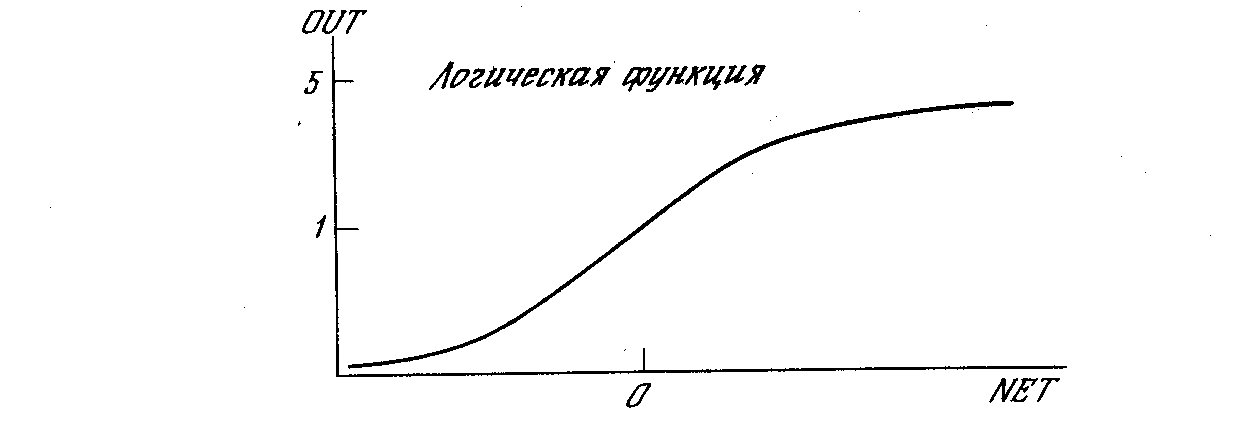

Рис. 2 Искусственный нейрон с активационной функцией

На рис. 2 блок, обозначенный F, принимает сигнал NET и выдает сигнал OUT. Если блок F сужает диапазон изменения величины NET так, что при любых значениях NET значения OUT принадлежат некоторому конечному интервалу, то F называется «сжимающей» функцией. В качестве «сжимающей» функции часто используется логистическая или «сигмоидальная» (S-образная) функция. Эта функция математически выражается как F(x) = 1/(1 + е-x). Таким образом,

.

.

По аналогии с электронными системами активационную функцию можно считать нелинейной усилительной характеристикой искусственного нейрона. Коэффициент усиления вычисляется как отношение приращения величины OUT к вызвавшему его небольшому приращению величины NET. Он выражается наклоном кривой при определенном уровне возбуждения и изменяется от малых значений при больших отрицательных возбуждениях (кривая почти горизонтальна) до максимального значения при нулевом возбуждении и снова уменьшается, когда возбуждение становится большим положительным. [8] Гроссберг (1973) обнаружил, что подобная нелинейная характеристика решает поставленную им дилемму шумового насыщения. Каким образом одна и та же сеть может обрабатывать как слабые, так и сильные сигналы? Слабые сигналы нуждаются в большом сетевом усилении, чтобы дать пригодный к использованию выходной сигнал. Однако усилительные каскады с большими коэффициентами усиления могут привести к насыщению выхода шумами усилителей (случайными флуктуациями), которые присутствуют в любой физически реализованной сети. Сильные входные сигналы в свою очередь также будут приводить к насыщению усилительных каскадов, исключая возможность полезного использования выхода. Центральная область логистической функции, имеющая большой коэффициент усиления, решает проблему обработки слабых сигналов, в то время как области с падающим усилением на положительном и отрицательном концах подходят для больших возбуждений. Таким образом, нейрон функционирует с большим усилением в широком диапазоне уровня входного сигнала.[9]

.

.

Рис. 3 Сигмоидальная логистическая функция

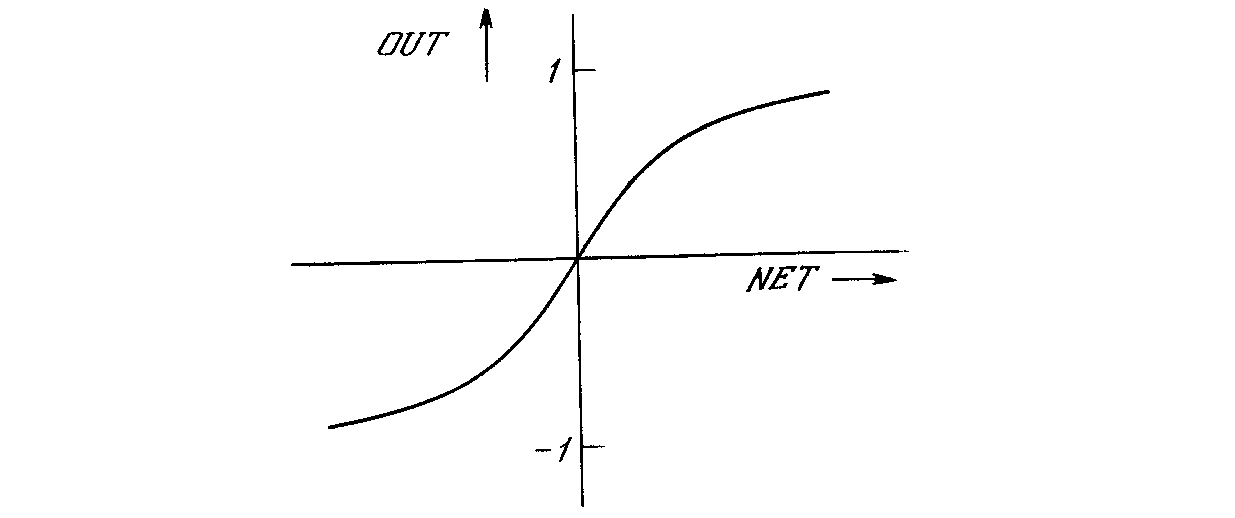

Другой широко используемой активационной функцией является гиперболический тангенс. По форме она сходна с логистической функцией и часто используется биологами в качестве математической модели активации нервной клетки. В качестве активационной функции искусственной нейронной сети она записывается следующим образом:

OUT = th(x).

Рис. 4 Функция гиперболического тангенса

Подобно логистической функции гиперболический тангенс является S-образной функцией, но он симметричен относительно начала координат, и в точке NET = 0 значение выходного сигнала OUT равно нулю. В отличие от логистической функции гиперболический тангенс принимает значения различных знаков, что оказывается выгодным для ряда сетей

Рассмотренная простая модель искусственного нейрона игнорирует многие свойства своего биологического двойника. Например, она не принимает во внимание задержки во времени, которые воздействуют на динамику системы. Входные сигналы сразу же порождают выходной сигнал. И, что более важно, она не учитывает воздействий функции частотной модуляции или синхронизирующей функции биологического нейрона, которые ряд исследователей считают решающими.

Несмотря на эти ограничения, сети, построенные из этих нейронов, обнаруживают свойства, сильно напоминающие биологическую систему. Только время и исследования смогут ответить на вопрос, являются ли подобные совпадения случайными или следствием того, что в модели верно схвачены важнейшие черты биологического нейрона.

Глава 4. Виды искусственных нейронных сетей

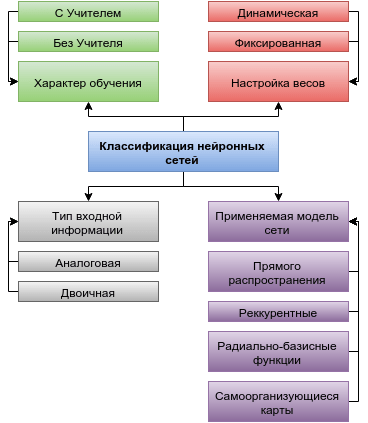

Можно провести следующую классификацию нейронных сетей:

Рис 5. Классификация нейронных сетей

Как мы видим нейронные сети классифицируются по 4 общим признакам. Рассмотрим каждый из них подробнее.

- По характеру обучения.

Классификация нейронных сетей по характеру обучения делит их на:

- нейронные сети, использующие обучение с учителем;

- нейронные сети, использующие обучение без учителя.

Рассмотрим это подробнее.

Нейронные сети, использующие обучение с учителем. Обучение с учителем предполагает, что для каждого входного вектора существует целевой вектор, представляющий собой требуемый выход. Вместе они называются обучающей парой. Обычно сеть обучается на некотором числе таких обучающих пар. Предъявляется выходной вектор, вычисляется выход сети и сравнивается с соответствующим целевым вектором. Далее веса изменяются в соответствии с алгоритмом, стремящимся минимизировать ошибку.

Векторы обучающего множества предъявляются последовательно, вычисляются ошибки и веса подстраиваются для каждого вектора до тех пор, пока ошибка по всему обучающему массиву не достигнет приемлемого уровня.[10]

Нейронные сети, использующие обучение без учителя. Обучение без учителя является намного более правдоподобной моделью обучения с точки зрения биологических корней искусственных нейронных сетей. Развитая Кохоненом и многими другими, она не нуждается в целевом векторе для выходов и, следовательно, не требует сравнения с предопределенными идеальными ответами. Обучающее множество состоит лишь из входных векторов.

Обучающий алгоритм подстраивает веса сети так, чтобы получались согласованные выходные векторы, т. е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы. Процесс обучения, следовательно, выделяет статистические свойства обучающего множества и группирует сходные векторы в классы.

2. По настройке весов

- сети с фиксированными связями – весовые коэффициенты нейронной сети выбираются сразу, исходя из условий задачи;

- сети с динамическими связями – для них в процессе обучения происходит настройка синаптических весов.

3. По типу входной связи

- аналоговая - входная информация представлена в форме действительных чисел;

- двоичная - вся входная информация в таких сетях представляется в виде нулей и единиц.

- образные нейронные сети - оперируют с информацией, представленной в виде образов: знаков, иероглифов, символов.

4. По модели нейронной сети

- Сети прямого распространения – все связи направлены строго от входных нейронов к выходным. К таким сетям относятся, например: простейший персептрон (разработанный Розенблаттом) и многослойный персептрон.

- Реккурентные нейронные сети – сигнал с выходных нейронов или нейронов скрытого слоя частично передается обратно на входы нейронов входного слоя.

- Радиально базисные функции – вид нейронной сети, имеющий скрытый слой из радиальных элементов и выходной слой из линейных элементов. Сети этого типа довольно компактны и быстро обучаются. Предложены в работах Broomhead and Lowe (1988) и Moody and Darkin (1989). Радиально базисная сеть обладает следующими особенностями: один скрытый слой, только нейроны скрытого слоя имеют нелинейную активационную функцию и синаптические веса входного и скрытого слоев равны единицы.

- Самоорганизующиеся карты или Сети Кохонена – такой класс сетей, как правило, обучается без учителя и успешно применяется в задачах распознавания. Сети такого класса способны выявлять новизну во входных данных: если после обучения сеть встретится с набором данных, непохожим ни на один из известных образцов, то она не сможет классифицировать такой набор и тем самым выявит его новизну. Сеть Кохонена имеет всего два слоя: входной и выходной, составленный из радиальных элементов.[11]

Глава 5. Обучение нейронных сетей

Каждая созданная нейронная сеть требует обучения, в противном случае правильный результат вряд ли будет получен.

Обучение – это процесс, в котором свободные параметры нейронной сети настраиваются посредством моделирования среды, в которую эта сеть встроена. Тип обучения определяется способом подстройки этих параметров.

Методов обучения нейросети существует несколько. Тем не менее среди них выделяют три наиболее интересных способов, это методы обратного и упругого распространения, а также генетический анализ. Тем не менее среди них выделяют три наиболее интересных способов, это методы обратного и упругого распространения, а также генетический анализ. О них и поговорим более подробно.

Существуют два концептуальных подхода к обучению нейронных сетей: обучение с учителем и обучение без учителя.

Обучение нейронной сети с учителем предполагает, что для каждого входного вектора из обучающего множества существует требуемое значение выходного вектора, называемого целевым. Эти вектора образуют обучающую пару. Веса сети изменяют до тех пор, пока для каждого входного вектора не будет получен приемлемый уровень отклонения выходного вектора от целевого.

Обучение нейронной сети без учителя является намного более правдоподобной моделью обучения с точки зрения биологических корней искусственных нейронных сетей. Обучающее множество состоит лишь из входных векторов. Алгоритм обучения нейронной сети подстраивает веса сети так, чтобы получались согласованные выходные векторы, т.е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы.

Есть ещё несколько методов обучения: стохастический метод вкратце можно описать так, нашлась величина обновления, значит, сразу же необходимо обновить соответствующий ей вес; пакетный метод суммирует значения всех величин в конкретном цикле и только по завершении проводит обновление, что значительно экономит время, однако, при этом страдает точность; мини-пакетный метод совмещает в себе плюсы вышеописанных методов, веса в свободном порядке распределяются по выбранным группам и меняются на сумму коэффициента коррекции всех весов группы.

В процессе любого обучения приходится применять гиперпараметры, подбор которых выполняется вручную, при этом они не являются переменными в определённом уравнении. Это уже упомянутые выше момент и скорость обучения. Также к этим параметрам можно отнести количество скрытых слоёв, число нейронов в слое, присутствие нейронов смещения или, наоборот, их отсутствие. Наличие гиперпараметров в первую очередь определяется типом искусственной нейронной сети. Правильный подбор их значений напрямую влияет на сходимость сети. В случае когда процесс обучения затягивается есть риск возникновения ситуации, в которой потребуется переобучение сети. Как правило, это происходит в момент, когда сеть перенасыщена данными и начинает не обучаться, а просто запоминать результаты для определённого набора входных параметров. И при подаче новых параметров возникают шумы, влияющие на результат.

Нейронные сети — очень перспективное направление разработки. Создав нейронную сеть можно обучить её многому, в частности тому, что человек привык делать бессознательно, а соответственно алгоритм чего ему неизвестен. Считается, что нейросети являются аналогом человеческого мозга, возможно, это и так, но стоит помнить — это всего лишь копия, отдалённо напоминающая свой прототип.

Глава 6. Решение задачи нечеткой логики

Сейчас приступим к практической части курсовой работы.

Необходимо решить задачу используя программу MATHLAB Fuzzy Logic Toolbox.

Условие задачи:

В задаче требуется определить расход воды при поливе сельхозугодий. Входные сигналы:

а) количество с/х культур(много,мало)

б) температура воздуха летом

Выходной сигнал: расход воды на полив (большой, средний, малый)

Правила:

1. Если с/х культур много, лето засушливое, то расход воды большой

2. Если с/х культур много, лето нормальное, то расход воды средний

3. Если с/х культур мало, лето холодное, то расход воды маленький

Решение:

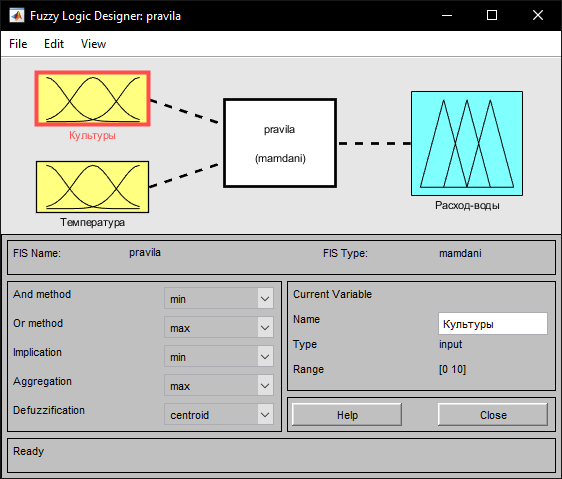

Для начала добавляем второй вход и переименовываем входы\выходы в соответствии с задачей

Рис 6. Вид задачи в Fuzzy Toolbox

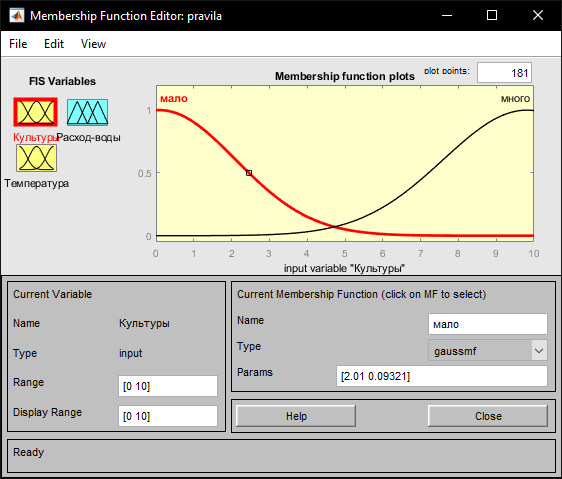

Рис 7. Переменные для с/х культур

Затем выставляем функции для входа «Культура»

Устанавливаем два значения «мало» и «много».

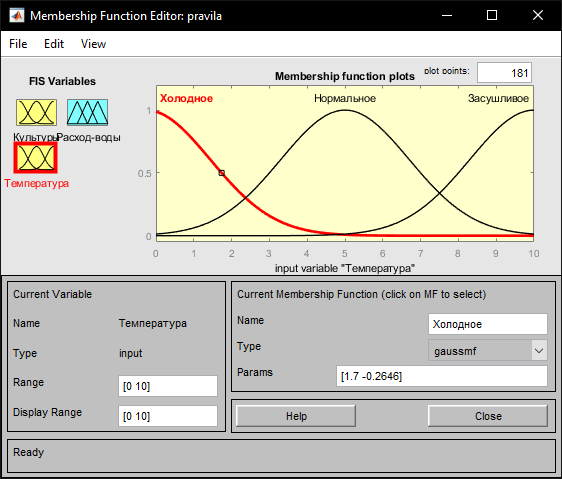

Рис 8. Фенкции для температуры лета

Для температуры лета задаем 3 функции. Холодное, нормальное и засушливое.

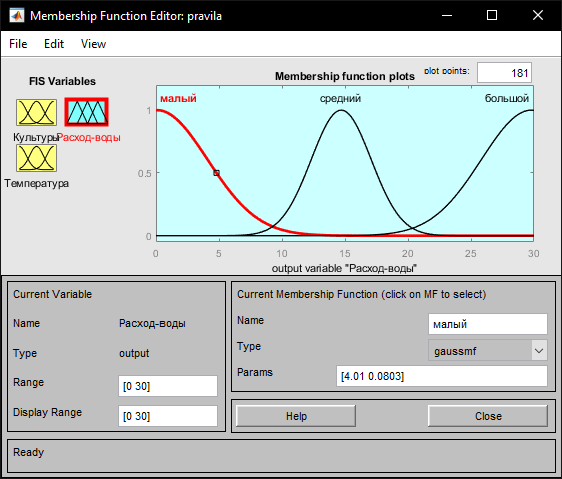

Рис 9. Функции для расхода воды

Далее задаем функции для значения расхода воды.

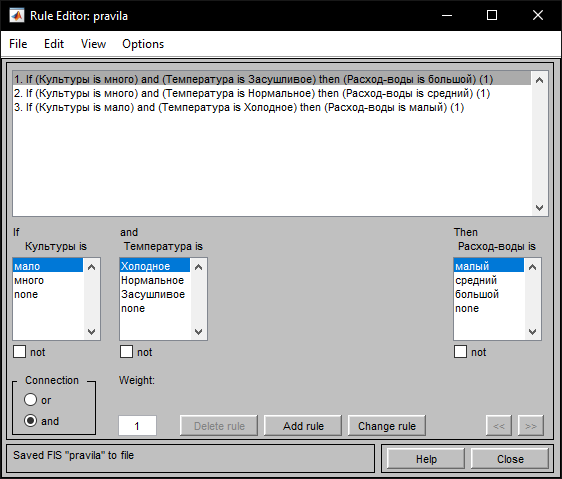

Рис 10. Правила

Далее устанавливаем правила в соответствии с условиями задачи.

Все данные из условия введены в программу теперь посмотрим на результат.

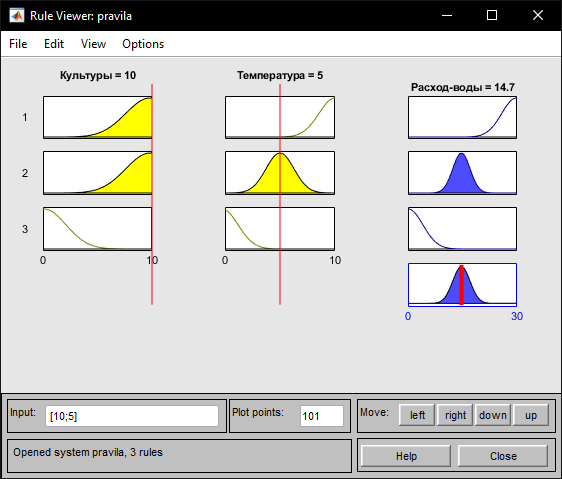

Рис 11. Проверка второго правила

Сейчас мы проверим поведение переменной расхода воды при различных входных значениях исходя из правил которые указаны в условии. Если мы установим:

Культуры = 10 и Температура = 5 тогда Расход воды = 14.8

Что соответствует второму правилу в задаче.

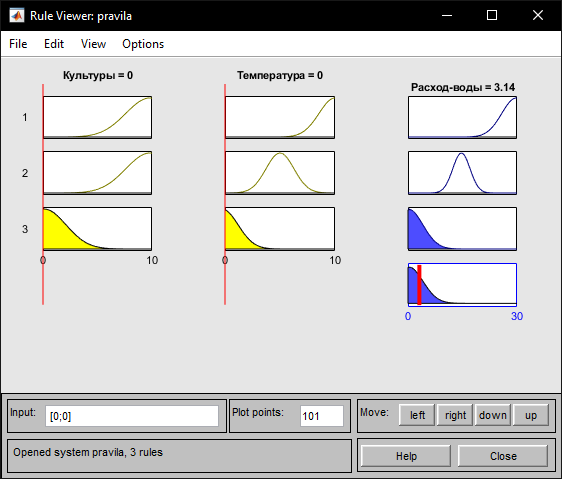

Рис 12. Проверка третьего правила

Затем проверим каков будет расход воды если мы выставим:

Культуры = 0 и Температуры = 0 то Расход воды = 3.14

Исходя из правила задачи если с/х культур мало, лето холодное, то расход воды маленький, всё работает корректно.

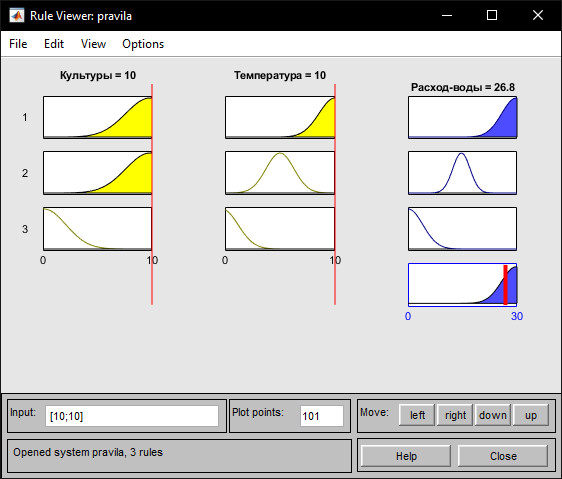

Рис 13. Проверка первого правила

Также проверим значение расхода воды при максимальных значениях переменных.

Если Культуры = 10 и Температура = 10 то Расход воды = 26.8

Что также соответствует первому правилу задачи.

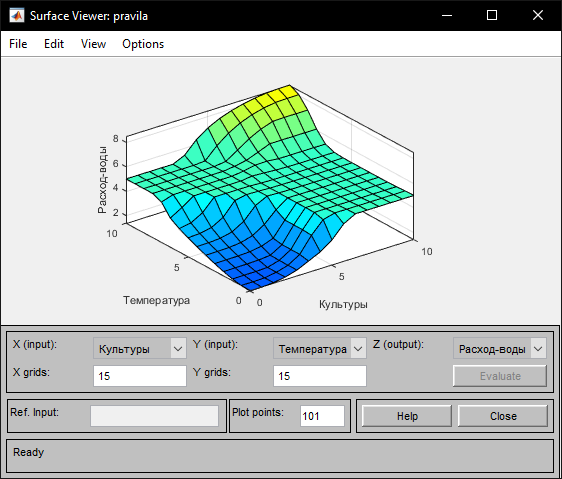

Рис 14. График расхода воды

Также построим график расхода воды для наглядного отображения его значений.

Заключение

Бурное развитие нейронных сетей, эволюционного моделирования и нечеткой логики приводит к большему их взаимодействию. И если раньше они развивались параллельно друг от друга, то теперь уже идут бок о бок. На первый план, как апогей такого взаимодействия выходит создание искусственного интеллекта. И хотя сама идея его создания появилась задолго до появления нейронных сетей, эволюционного моделирования и нечеткой логики на данном этапе стало понятно, что симбиоз этих трех методов ляжет своей основой для искусственного интеллекта.

Нейронные сети, эволюционное моделирование и нечеткая логика бурно развиваются и находят всё новые и новые ниши для себя. При этом идет создание искусственного интеллекта. С каждым годом идей и программ с применением алгоритмов нейронных сетей, эволюционного моделирования и нечеткой логики становится всё больше и больше.

Также в работе мы успешно решили задачу на нечеткую логику. При решении мы воспользовались программой MATHLAB Fuzzy Logic Toolbox для моделирования результатов.

Список литературы

-

- Амоносов Н. М., Алгоритмы разума/ Киев. Изд. Наукова думка 1979.

- Барский А. Б., Нейронные сети: распознавание, управление, принятие решений/ Москва, Финансы и статистика, 2004.

- Беркинблит М. Б., Нейронные сети: учебное пособие/ Москва, Миросс 1993 г..

- Роберт Каллан, Основные концепции нейронных сетей./Издательский дом “Вильямс”, 2001.

5. Заенцев И. В. Нейронные сети: основные модели И. В. Заенцев. — Воронеж: Изд-во Воронежского госуд. ун-та, 1999. — 76 с.

6. Вороновкий Г. К. Генетические алгоритмы, искусственные нейронные сети и проблемы виртуальной реальности Г. К. Вороновский, К. В. Махотило, С. Н. Петрашев, С. А. Сергеев. — Х.: ОСНОВА, 1997. — 112 с.

7. Рутковская Д. Нейронные сети, генетические алгоритмы и нечёткие системы Д. Рутковская, М. Пилиньский, Л. Рутковский. — М.: Горячая линия Телеком, 2006. — 452 с.

8. Каллан Р. Основные концепции нейронных сетей Р. Каллан. — Москва, Санкт-Петербург, Киев: Издательский дом «Вильямс», 2001. — 287 с

9. Джонс М.Т. Программирование искусственного интеллекта в приложениях М. Тим Джонс; Пер. с англ. Осипов А. И. — М.: ДМК Пресс, 2006. — 312 с.

-

Амоносов Н. М., Алгоритмы разума/ Киев. Изд. Наукова думка 1979. ↑

-

Роберт Каллан, Основные концепции нейронных сетей./Издательский дом “Вильямс”, 2001. ↑

-

Заенцев И. В. Нейронные сети: основные модели И. В. Заенцев. — Воронеж: Изд-во Воронежского госуд. ун-та, 1999. — 76 с. ↑

-

Вороновкий Г. К. Генетические алгоритмы, искусственные нейронные сети и проблемы виртуальной реальности Г. К. Вороновский, К. В. Махотило, С. Н. Петрашев, С. А. Сергеев. — Х.: ОСНОВА, 1997. — 112 с. ↑

-

Беркинблит М. Б., Нейронные сети: учебное пособие/ Москва, Миросс 1993 г.. ↑

-

Барский А. Б., Нейронные сети: распознавание, управление, принятие решений/ Москва, Финансы и статистика, 2004. ↑

-

Рутковская Д. Нейронные сети, генетические алгоритмы и нечёткие системы Д. Рутковская, М. Пилиньский, Л. Рутковский. — М.: Горячая линия Телеком, 2006 ↑

-

Каллан Р. Основные концепции нейронных сетей Р. Каллан. — Москва, Санкт-Петербург, Киев: Издательский дом «Вильямс», 2001. ↑

-

Джонс М.Т. Программирование искусственного интеллекта в приложениях М. Тим Джонс; Пер. с англ. Осипов А. И. — М.: ДМК Пресс, 2006. ↑

-

Заенцев И. В. Нейронные сети: основные модели И. В. Заенцев. — Воронеж: Изд-во Воронежского госуд. ун-та, 1999. ↑

-

Заенцев И. В. Нейронные сети: основные модели И. В. Заенцев. — Воронеж: Изд-во Воронежского госуд. ун-та, 1999. ↑

- Анализ сущности и постройка диаграммы классов

- Общий порядок создания, реорганизации, ликвидации субъектов предпринимательского права

- Общее понятие о гражданском праве (Понятие предмета гражданского права)

- Принципы построения и функционирования DLP-систем.(Классификация DLP-систем)

- Индивидуальное предпринимательство

- Анализ денежных средств предприятия (на примере ООО «ЛОРГУС»)а1.1

- Основные виды и понятия ценных бумаг

- Юридическая сущность предпринимательского права.

- Правовое регулирование рекламной деятельности (Регулирование рынка рекламы)

- Понятие и виды ценных бумаг, их свойства

- Динамические структуры данных. Списки (Структура программы и языка программирования)

- Ввод и вывод в языке С++